Debut en 2026, Jensen Huang lanza una "bomba nuclear" de 2,5 toneladas en el evento|CES2026

Mostrar el original

Por:爱范儿

*Al final hay un pequeño video sorpresa. Es la primera vez en cinco años que Nvidia no lanza una tarjeta gráfica de consumo en el CES. El CEO Jensen Huang avanzó con paso firme hacia el centro del escenario de NVIDIA Live, vistiendo la misma campera de cuero de cocodrilo brillante del año pasado.  A diferencia de la charla magistral en solitario del año pasado, en 2026 Jensen Huang estuvo a full de eventos. De NVIDIA Live al diálogo sobre IA industrial con Siemens y luego al Lenovo TechWorld, participando en tres actividades en 48 horas. La última vez, presentó la serie de tarjetas gráficas RTX 50 en el CES. Pero esta vez, la IA física, la robótica y una “ bomba nuclear de nivel empresarial ” se convirtieron en los verdaderos protagonistas. Debuta la plataforma de cómputo Vera Rubin: mientras más compras, más ahorras Durante la presentación, el siempre creativo Jensen subió al escenario un rack de servidor de IA de 2,5 toneladas, lo que sirvió de introducción al foco del evento: la plataforma de cómputo Vera Rubin, nombrada en honor a la astrónoma que descubrió la materia oscura, con un único objetivo: Acelerar la velocidad de entrenamiento de IA y adelantar la llegada de la próxima generación de modelos.

A diferencia de la charla magistral en solitario del año pasado, en 2026 Jensen Huang estuvo a full de eventos. De NVIDIA Live al diálogo sobre IA industrial con Siemens y luego al Lenovo TechWorld, participando en tres actividades en 48 horas. La última vez, presentó la serie de tarjetas gráficas RTX 50 en el CES. Pero esta vez, la IA física, la robótica y una “ bomba nuclear de nivel empresarial ” se convirtieron en los verdaderos protagonistas. Debuta la plataforma de cómputo Vera Rubin: mientras más compras, más ahorras Durante la presentación, el siempre creativo Jensen subió al escenario un rack de servidor de IA de 2,5 toneladas, lo que sirvió de introducción al foco del evento: la plataforma de cómputo Vera Rubin, nombrada en honor a la astrónoma que descubrió la materia oscura, con un único objetivo: Acelerar la velocidad de entrenamiento de IA y adelantar la llegada de la próxima generación de modelos.  Normalmente, en Nvidia hay una regla interna: cada generación de productos solo cambia un máximo de 1-2 chips. Pero esta vez, Vera Rubin rompió la regla y rediseñó de una sola vez 6 chips, los cuales ya están en plena producción masiva.

Normalmente, en Nvidia hay una regla interna: cada generación de productos solo cambia un máximo de 1-2 chips. Pero esta vez, Vera Rubin rompió la regla y rediseñó de una sola vez 6 chips, los cuales ya están en plena producción masiva.

¿La razón? Con la desaceleración de la Ley de Moore, las formas tradicionales de mejorar el rendimiento ya no siguen el ritmo del crecimiento exponencial anual de los modelos de IA, así que Nvidia apostó por el “diseño colaborativo extremo”: innovando en todos los chips y en todos los niveles de la plataforma al mismo tiempo. Estos 6 chips son: 1. Vera CPU: - 88 núcleos Olympus personalizados de NVIDIA - Tecnología de multihilo espacial de NVIDIA, soporta 176 hilos - Ancho de banda NVLink C2C de 1,8 TB/s - Memoria del sistema de 1,5 TB (3 veces la de Grace) - Ancho de banda LPDDR5X de 1,2 TB/s - 227 mil millones de transistores

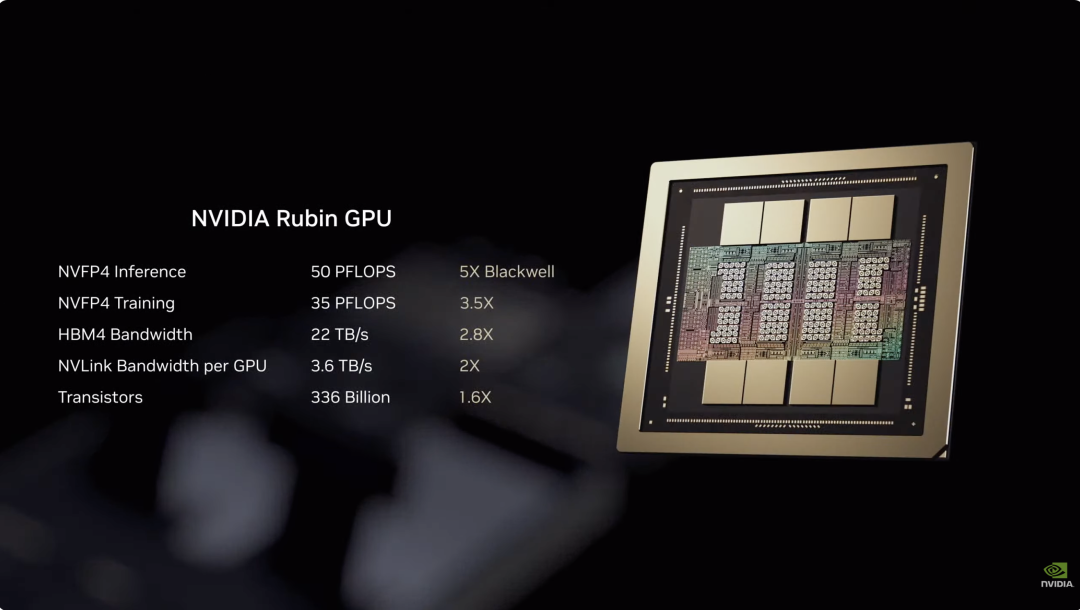

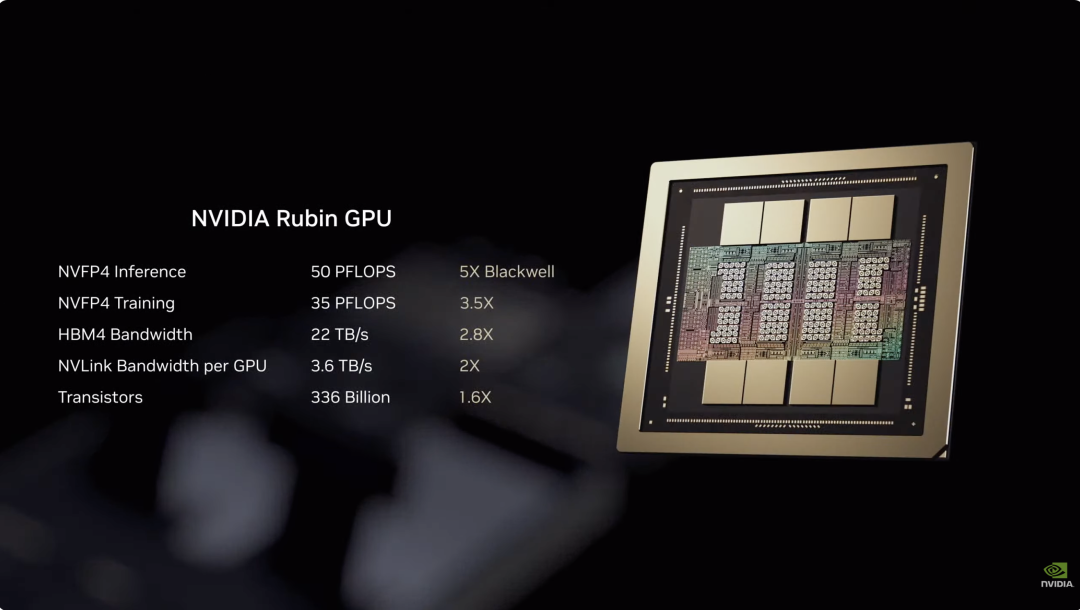

Estos 6 chips son: 1. Vera CPU: - 88 núcleos Olympus personalizados de NVIDIA - Tecnología de multihilo espacial de NVIDIA, soporta 176 hilos - Ancho de banda NVLink C2C de 1,8 TB/s - Memoria del sistema de 1,5 TB (3 veces la de Grace) - Ancho de banda LPDDR5X de 1,2 TB/s - 227 mil millones de transistores  2. Rubin GPU: - 50 PFLOPS de inferencia NVFP4, 5 veces más que la generación anterior Blackwell - 336 mil millones de transistores, 1,6 veces más que Blackwell - Tercera generación del motor Transformer, que ajusta la precisión dinámicamente según el modelo Transformer

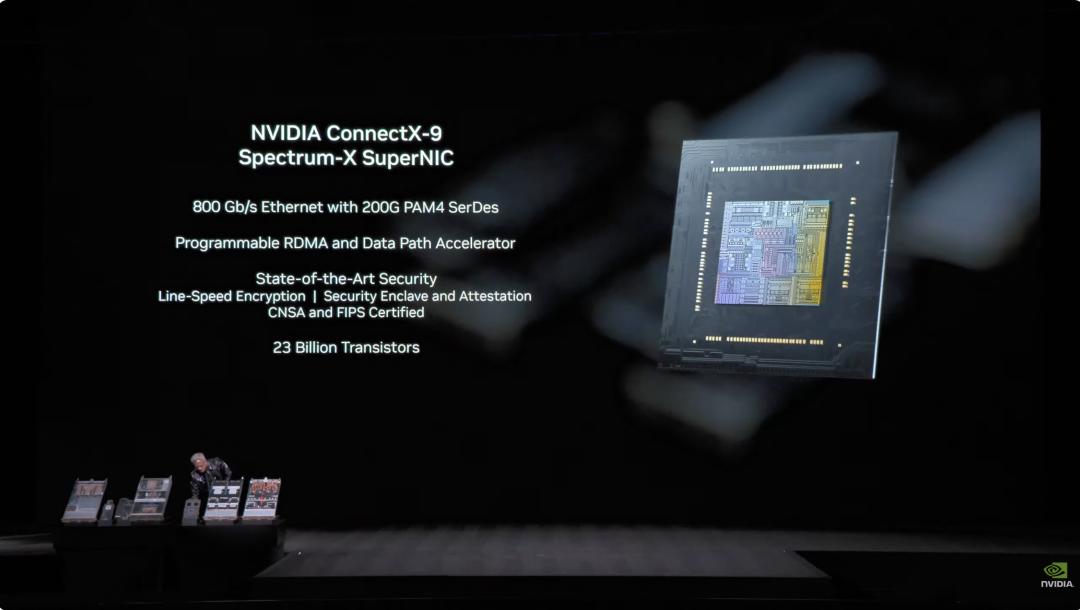

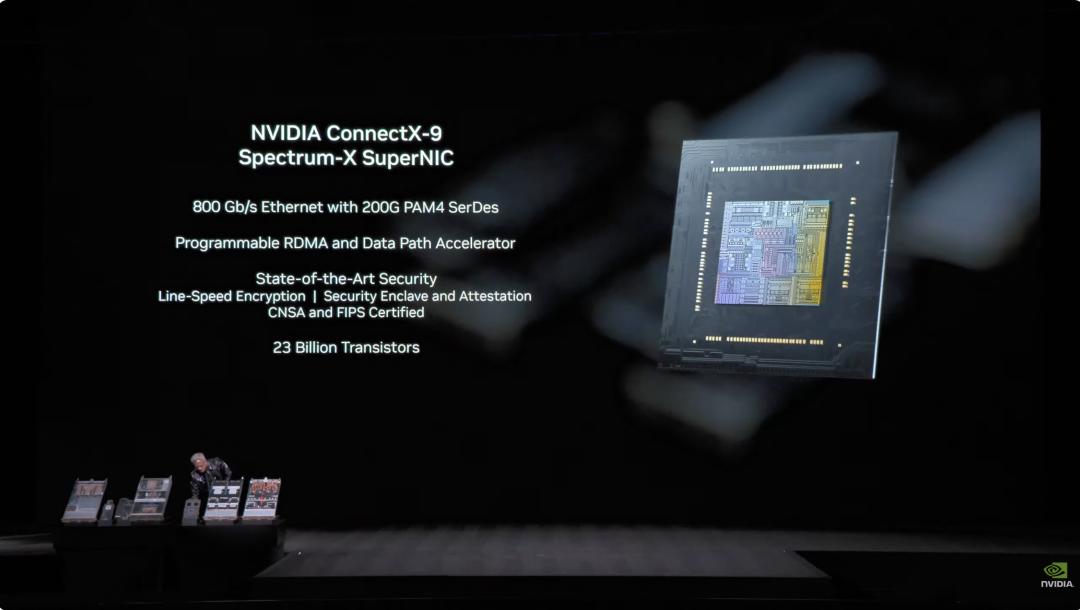

2. Rubin GPU: - 50 PFLOPS de inferencia NVFP4, 5 veces más que la generación anterior Blackwell - 336 mil millones de transistores, 1,6 veces más que Blackwell - Tercera generación del motor Transformer, que ajusta la precisión dinámicamente según el modelo Transformer  3. Placa de red ConnectX-9: - Ethernet de 800 Gb/s basada en 200G PAM4 SerDes - RDMA programable y acelerador de ruta de datos - Certificaciones CNSA y FIPS - 23 mil millones de transistores

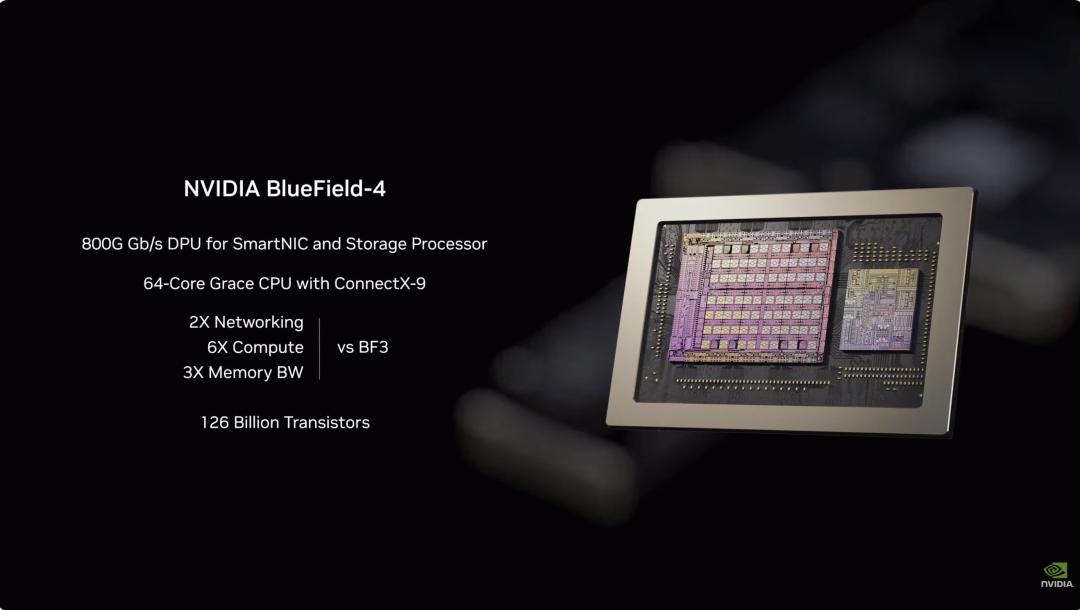

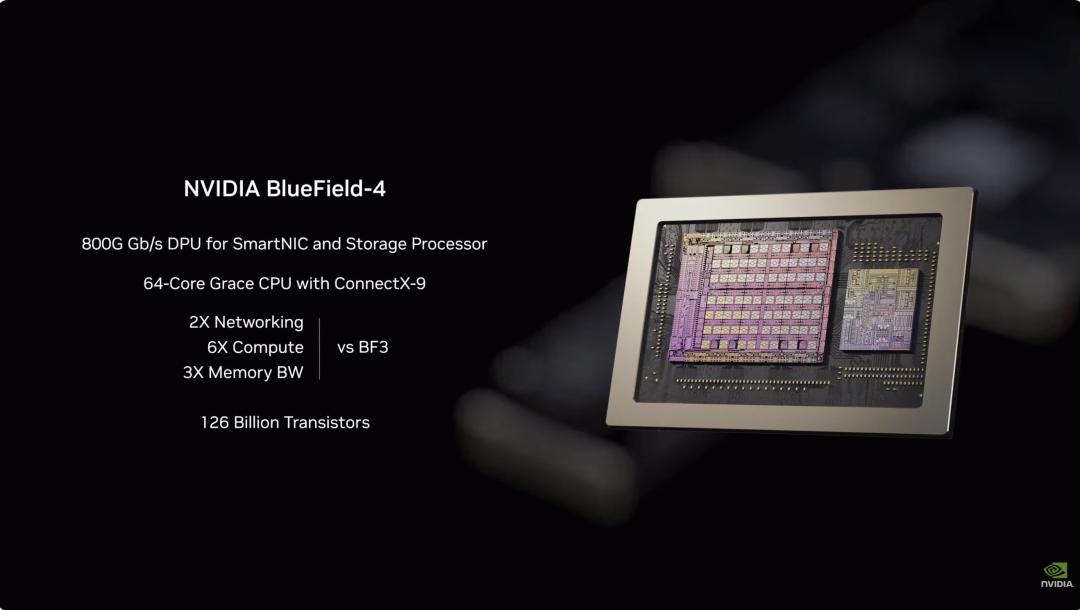

3. Placa de red ConnectX-9: - Ethernet de 800 Gb/s basada en 200G PAM4 SerDes - RDMA programable y acelerador de ruta de datos - Certificaciones CNSA y FIPS - 23 mil millones de transistores  4. BlueField-4 DPU: - Motor de extremo a extremo diseñado para la nueva generación de plataformas de almacenamiento IA - DPU de 800G Gb/s para SmartNIC y procesadores de almacenamiento - CPU Grace de 64 núcleos junto a ConnectX-9 - 126 mil millones de transistores

4. BlueField-4 DPU: - Motor de extremo a extremo diseñado para la nueva generación de plataformas de almacenamiento IA - DPU de 800G Gb/s para SmartNIC y procesadores de almacenamiento - CPU Grace de 64 núcleos junto a ConnectX-9 - 126 mil millones de transistores  5. Chip de conmutación NVLink-6: - Conecta 18 nodos de cómputo, soporta hasta 72 GPUs Rubin funcionando como un solo conjunto - En la arquitectura NVLink 6, cada GPU puede alcanzar 3,6 TB por segundo de ancho de banda all-to-all - Usa 400G SerDes, soporta In-Network SHARP Collectives, permitiendo operaciones colectivas dentro de la red de switches

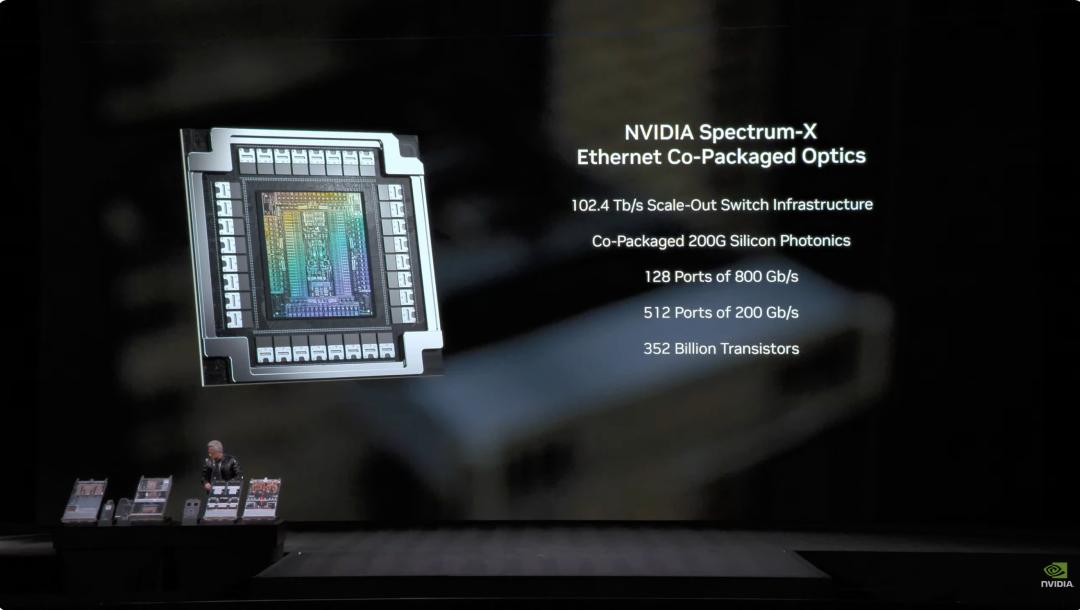

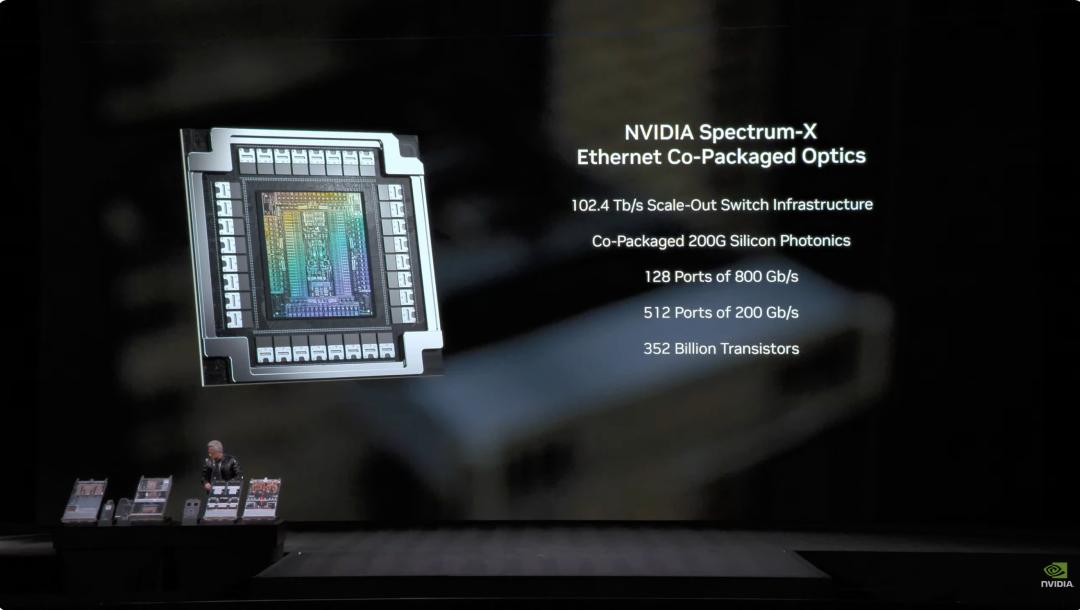

5. Chip de conmutación NVLink-6: - Conecta 18 nodos de cómputo, soporta hasta 72 GPUs Rubin funcionando como un solo conjunto - En la arquitectura NVLink 6, cada GPU puede alcanzar 3,6 TB por segundo de ancho de banda all-to-all - Usa 400G SerDes, soporta In-Network SHARP Collectives, permitiendo operaciones colectivas dentro de la red de switches  6. Chip de conmutación óptica Spectrum-6 Ethernet - 512 canales, 200Gbps por canal, para una transmisión de datos ultra rápida - Tecnología de silicio fotónico con proceso COOP de TSMC - Interfaz óptica copackaged - 352 mil millones de transistores

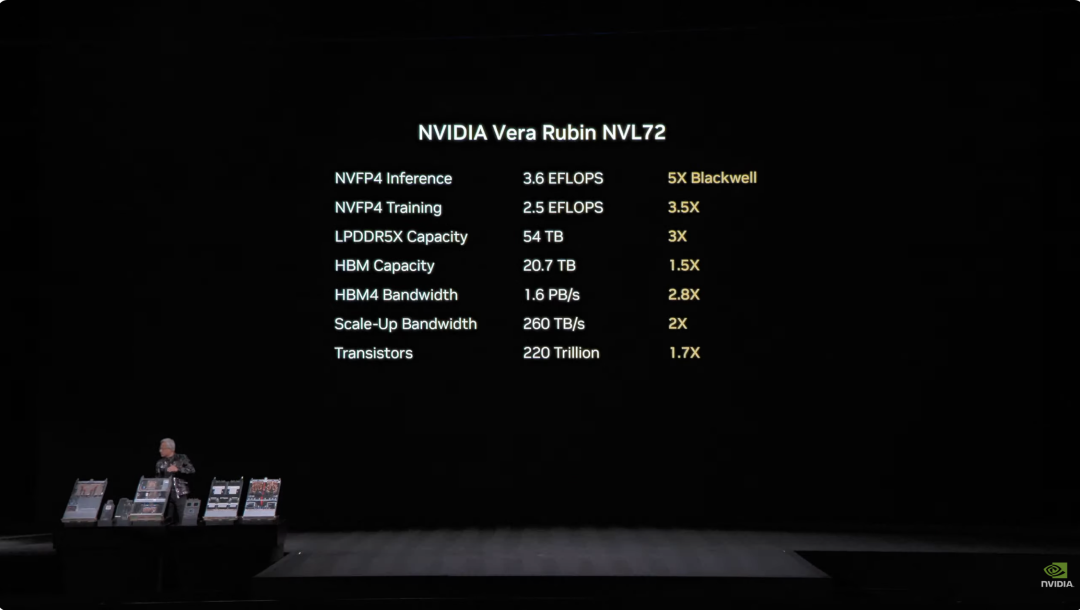

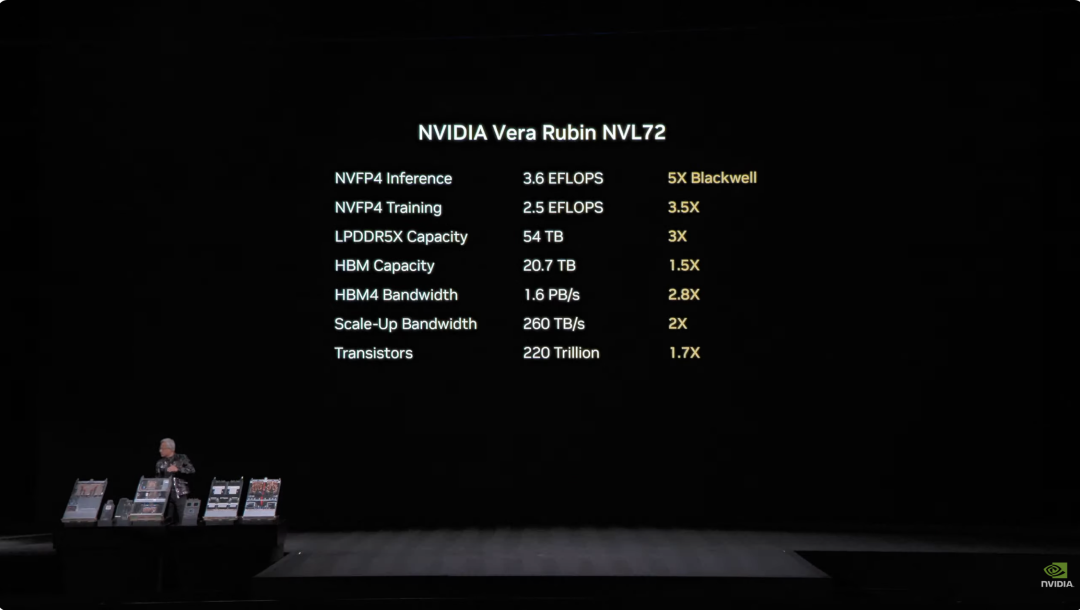

6. Chip de conmutación óptica Spectrum-6 Ethernet - 512 canales, 200Gbps por canal, para una transmisión de datos ultra rápida - Tecnología de silicio fotónico con proceso COOP de TSMC - Interfaz óptica copackaged - 352 mil millones de transistores  Gracias a la integración profunda de estos 6 chips, el sistema Vera Rubin NVL72 supera en todos los aspectos a la generación anterior Blackwell. En tareas de inferencia NVFP4, este chip alcanzó 3,6 EFLOPS, 5 veces más que la arquitectura Blackwell previa. En entrenamiento NVFP4, el rendimiento llegó a 2,5 EFLOPS, un aumento de 3,5 veces. En cuanto a capacidad de almacenamiento, NVL72 cuenta con 54TB de memoria LPDDR5X, 3 veces más que la generación anterior. La memoria HBM (de alto ancho de banda) alcanza los 20,7TB, un 50% más. En ancho de banda, HBM4 alcanza 1,6 PB/s, un aumento de 2,8 veces; el ancho de banda Scale-Up llega a 260 TB/s, duplicando la cifra anterior. A pesar de este salto en el rendimiento, la cantidad de transistores solo aumentó 1,7 veces, llegando a 220 billones, demostrando la innovación en la tecnología de fabricación de semiconductores.

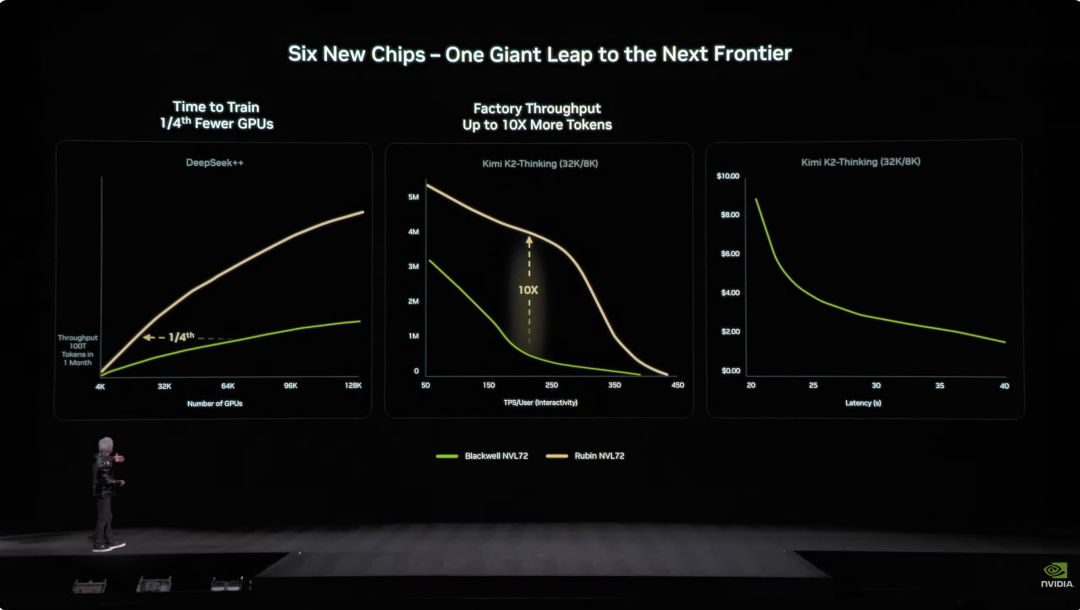

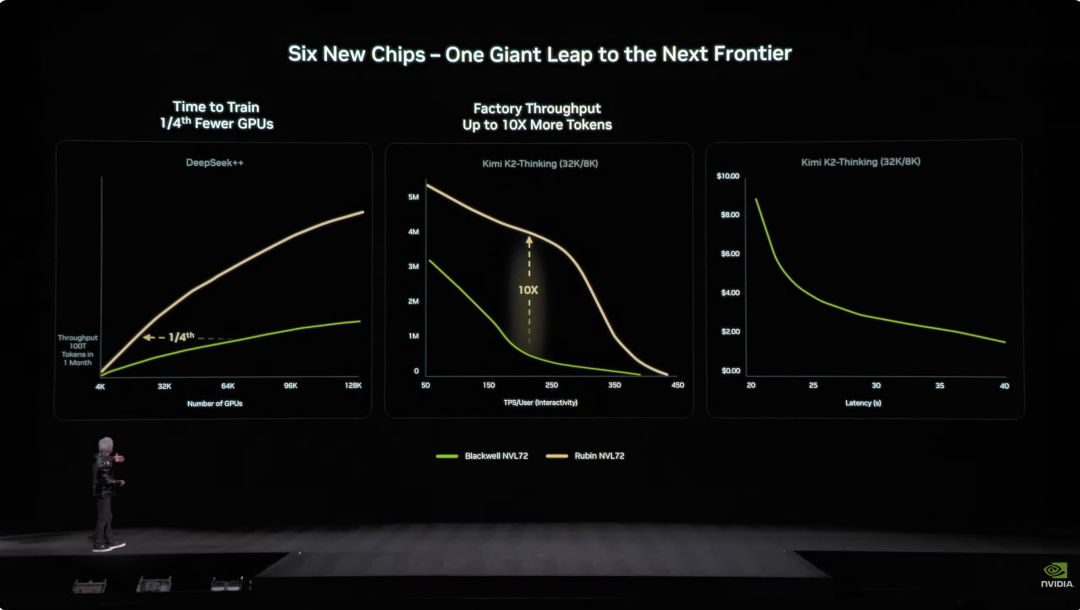

Gracias a la integración profunda de estos 6 chips, el sistema Vera Rubin NVL72 supera en todos los aspectos a la generación anterior Blackwell. En tareas de inferencia NVFP4, este chip alcanzó 3,6 EFLOPS, 5 veces más que la arquitectura Blackwell previa. En entrenamiento NVFP4, el rendimiento llegó a 2,5 EFLOPS, un aumento de 3,5 veces. En cuanto a capacidad de almacenamiento, NVL72 cuenta con 54TB de memoria LPDDR5X, 3 veces más que la generación anterior. La memoria HBM (de alto ancho de banda) alcanza los 20,7TB, un 50% más. En ancho de banda, HBM4 alcanza 1,6 PB/s, un aumento de 2,8 veces; el ancho de banda Scale-Up llega a 260 TB/s, duplicando la cifra anterior. A pesar de este salto en el rendimiento, la cantidad de transistores solo aumentó 1,7 veces, llegando a 220 billones, demostrando la innovación en la tecnología de fabricación de semiconductores.  En diseño de ingeniería, Vera Rubin también trajo avances importantes. Antes, cada nodo de supercomputadora necesitaba 43 cables y dos horas de ensamblaje, con alto riesgo de errores. Ahora, el nodo Vera Rubin usa cero cables, solo 6 tubos de refrigeración líquida, y se arma en 5 minutos. Más impresionante aún: la parte trasera del rack está llena de casi 3,2 km de cable de cobre, 5.000 cables formando la red troncal NVLink, alcanzando 400Gbps de velocidad. Según Jensen: “Puede que pese cientos de libras, tenés que ser un CEO bastante fuerte para este trabajo”. En el mundo de la IA, el tiempo es dinero. Un dato clave: para entrenar un modelo de 10 billones de parámetros, Rubin necesita solo una cuarta parte de los sistemas Blackwell y el costo por token generado es un décimo del de Blackwell.

En diseño de ingeniería, Vera Rubin también trajo avances importantes. Antes, cada nodo de supercomputadora necesitaba 43 cables y dos horas de ensamblaje, con alto riesgo de errores. Ahora, el nodo Vera Rubin usa cero cables, solo 6 tubos de refrigeración líquida, y se arma en 5 minutos. Más impresionante aún: la parte trasera del rack está llena de casi 3,2 km de cable de cobre, 5.000 cables formando la red troncal NVLink, alcanzando 400Gbps de velocidad. Según Jensen: “Puede que pese cientos de libras, tenés que ser un CEO bastante fuerte para este trabajo”. En el mundo de la IA, el tiempo es dinero. Un dato clave: para entrenar un modelo de 10 billones de parámetros, Rubin necesita solo una cuarta parte de los sistemas Blackwell y el costo por token generado es un décimo del de Blackwell.  Además, aunque el consumo de Rubin es el doble que el de Grace Blackwell, el rendimiento supera ampliamente ese aumento: 5 veces más en inferencia, 3,5 veces más en entrenamiento. Aún más importante, Rubin aumenta el throughput (tokens de IA por watt por dólar) 10 veces respecto a Blackwell. Para un datacenter de gigavatios que cuesta 50.000 millones de dólares, esto puede significar duplicar la capacidad de generación de ingresos. Hasta ahora, el mayor problema de la industria IA era la falta de memoria contextual. En concreto, la IA genera un “KV Cache” (memoria clave-valor), algo así como su “memoria de trabajo”. El problema es que, a medida que las conversaciones se alargan y los modelos crecen, la memoria HBM se queda corta.

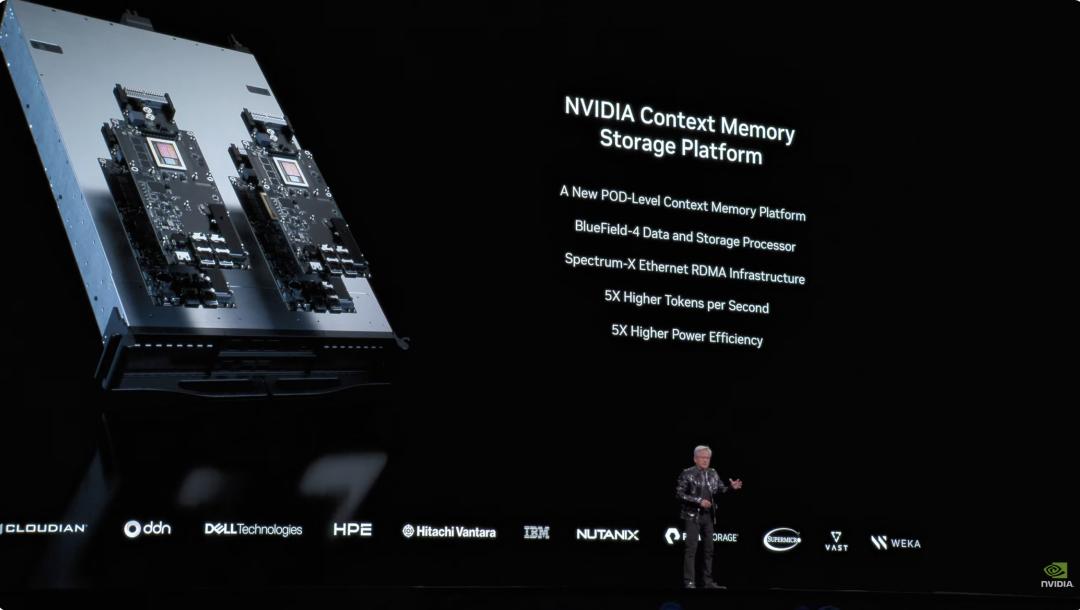

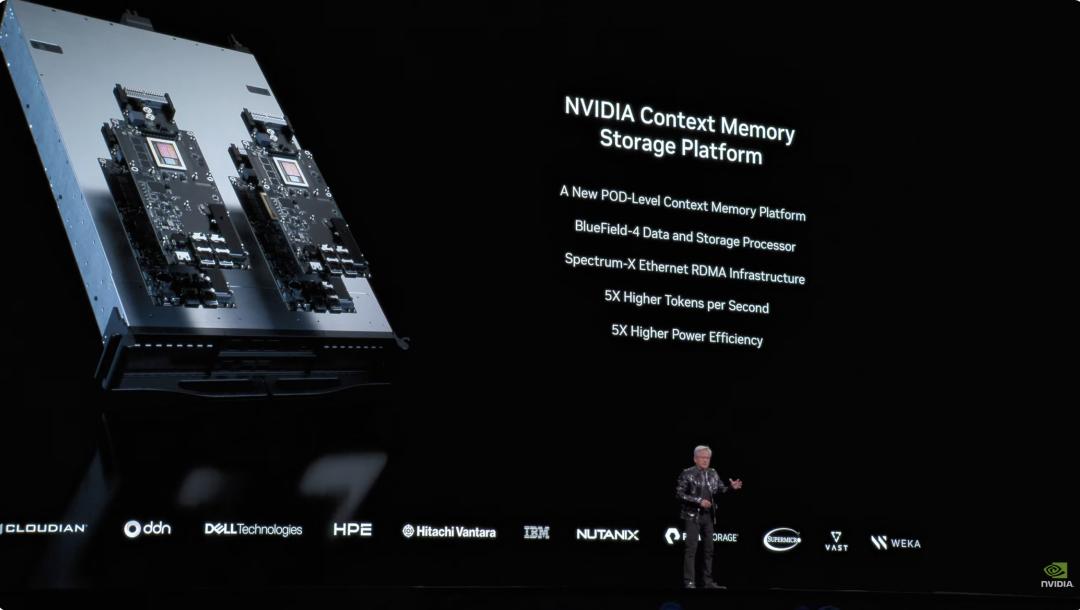

Además, aunque el consumo de Rubin es el doble que el de Grace Blackwell, el rendimiento supera ampliamente ese aumento: 5 veces más en inferencia, 3,5 veces más en entrenamiento. Aún más importante, Rubin aumenta el throughput (tokens de IA por watt por dólar) 10 veces respecto a Blackwell. Para un datacenter de gigavatios que cuesta 50.000 millones de dólares, esto puede significar duplicar la capacidad de generación de ingresos. Hasta ahora, el mayor problema de la industria IA era la falta de memoria contextual. En concreto, la IA genera un “KV Cache” (memoria clave-valor), algo así como su “memoria de trabajo”. El problema es que, a medida que las conversaciones se alargan y los modelos crecen, la memoria HBM se queda corta.  El año pasado Nvidia amplió la memoria con la arquitectura Grace-Blackwell, pero tampoco fue suficiente. Vera Rubin soluciona esto instalando procesadores BlueField-4 en el rack, dedicados a gestionar el KV Cache. Cada nodo tiene 4 BlueField-4, cada uno con 150TB de memoria contextual, que se reparte a las GPUs. Así, cada GPU recibe 16TB extra de memoria, cuando la interna es solo de 1TB, y lo mejor, el ancho de banda se mantiene en 200Gbps sin sacrificar velocidad. Pero no basta con capacidad: para que las “notas adhesivas” distribuidas en decenas de racks y miles de GPUs trabajen como una sola memoria, la red debe ser “suficientemente grande, rápida y estable”. Ahí entra Spectrum-X. Spectrum-X es la primera plataforma Ethernet de punta a punta del mundo “diseñada para IA generativa”. La nueva generación usa tecnología COOP de TSMC, integra silicio fotónico y ofrece 512 canales a 200Gbps cada uno. Jensen hizo la cuenta: un datacenter de 1GW cuesta 50.000 millones de dólares, y Spectrum-X puede aumentar el throughput en un 25%, ahorrando 5.000 millones. “Podés decir que este sistema de red es prácticamente gratis”. En seguridad, Vera Rubin soporta Confidential Computing. Todos los datos están encriptados durante transmisión, almacenamiento y computación, incluyendo los buses PCIe, NVLink y CPU-GPU. Las empresas pueden desplegar sus modelos en sistemas externos sin temor a fugas de datos. DeepSeek sorprendió al mundo: la comunidad open source y los agentes inteligentes son la corriente principal de la IA Terminada la parte fuerte, volvamos al inicio de la charla. Apenas subió al escenario, Jensen Huang lanzó una cifra impactante: unos 10 billones de dólares invertidos en recursos de cómputo en la última década están siendo completamente modernizados. Pero esto no es solo una actualización de hardware, sino un cambio de paradigma de software. Habló especialmente de los modelos de agentes inteligentes (Agentic), mencionando a Cursor, que cambió radicalmente la programación interna de Nvidia.

El año pasado Nvidia amplió la memoria con la arquitectura Grace-Blackwell, pero tampoco fue suficiente. Vera Rubin soluciona esto instalando procesadores BlueField-4 en el rack, dedicados a gestionar el KV Cache. Cada nodo tiene 4 BlueField-4, cada uno con 150TB de memoria contextual, que se reparte a las GPUs. Así, cada GPU recibe 16TB extra de memoria, cuando la interna es solo de 1TB, y lo mejor, el ancho de banda se mantiene en 200Gbps sin sacrificar velocidad. Pero no basta con capacidad: para que las “notas adhesivas” distribuidas en decenas de racks y miles de GPUs trabajen como una sola memoria, la red debe ser “suficientemente grande, rápida y estable”. Ahí entra Spectrum-X. Spectrum-X es la primera plataforma Ethernet de punta a punta del mundo “diseñada para IA generativa”. La nueva generación usa tecnología COOP de TSMC, integra silicio fotónico y ofrece 512 canales a 200Gbps cada uno. Jensen hizo la cuenta: un datacenter de 1GW cuesta 50.000 millones de dólares, y Spectrum-X puede aumentar el throughput en un 25%, ahorrando 5.000 millones. “Podés decir que este sistema de red es prácticamente gratis”. En seguridad, Vera Rubin soporta Confidential Computing. Todos los datos están encriptados durante transmisión, almacenamiento y computación, incluyendo los buses PCIe, NVLink y CPU-GPU. Las empresas pueden desplegar sus modelos en sistemas externos sin temor a fugas de datos. DeepSeek sorprendió al mundo: la comunidad open source y los agentes inteligentes son la corriente principal de la IA Terminada la parte fuerte, volvamos al inicio de la charla. Apenas subió al escenario, Jensen Huang lanzó una cifra impactante: unos 10 billones de dólares invertidos en recursos de cómputo en la última década están siendo completamente modernizados. Pero esto no es solo una actualización de hardware, sino un cambio de paradigma de software. Habló especialmente de los modelos de agentes inteligentes (Agentic), mencionando a Cursor, que cambió radicalmente la programación interna de Nvidia.  Lo que más entusiasmó al público fue su gran valoración de la comunidad open source. Jensen fue directo: el avance de DeepSeek V1 sorprendió a todo el mundo; como primer sistema de inferencia open source, impulsó el desarrollo de todo el sector. En la PPT, los modelos chinos Kimi k2 y DeepSeek V3.2 eran primero y segundo en open source. Según Jensen Huang, aunque los modelos open source hoy estén unos seis meses detrás de los top, cada seis meses aparece uno nuevo. Esta velocidad de iteración atrae tanto a startups, gigantes y académicos, incluyendo a Nvidia. Por eso, esta vez no solo vendieron palas y tarjetas gráficas; Nvidia construyó la supercomputadora DGX Cloud, valuada en miles de millones de dólares, y desarrolló modelos de vanguardia como La Proteina (síntesis de proteínas) y OpenFold 3.

Lo que más entusiasmó al público fue su gran valoración de la comunidad open source. Jensen fue directo: el avance de DeepSeek V1 sorprendió a todo el mundo; como primer sistema de inferencia open source, impulsó el desarrollo de todo el sector. En la PPT, los modelos chinos Kimi k2 y DeepSeek V3.2 eran primero y segundo en open source. Según Jensen Huang, aunque los modelos open source hoy estén unos seis meses detrás de los top, cada seis meses aparece uno nuevo. Esta velocidad de iteración atrae tanto a startups, gigantes y académicos, incluyendo a Nvidia. Por eso, esta vez no solo vendieron palas y tarjetas gráficas; Nvidia construyó la supercomputadora DGX Cloud, valuada en miles de millones de dólares, y desarrolló modelos de vanguardia como La Proteina (síntesis de proteínas) y OpenFold 3.  El ecosistema open source de modelos de Nvidia cubre biomedicina, IA física, agentes inteligentes, robótica y conducción autónoma Y la familia de modelos open source Nemotron de Nvidia también fue protagonista de la presentación. Incluye modelos de voz, multimodales, generación aumentada por recuperación y seguridad, y Jensen mencionó que los Nemotron están obteniendo excelentes resultados en los rankings y están siendo adoptados por muchas empresas. ¿Qué es la IA física? Lanzamiento de decenas de modelos en un solo evento Si los grandes modelos de lenguaje solucionan los problemas del “mundo digital”, la próxima ambición de Nvidia es conquistar el “mundo físico”. Jensen comentó que para que la IA comprenda las leyes físicas y funcione en el mundo real, los datos son extremadamente escasos. Además del modelo de agente open source Nemotron, propuso una arquitectura central de “tres computadoras” para construir IA física (Physical AI).

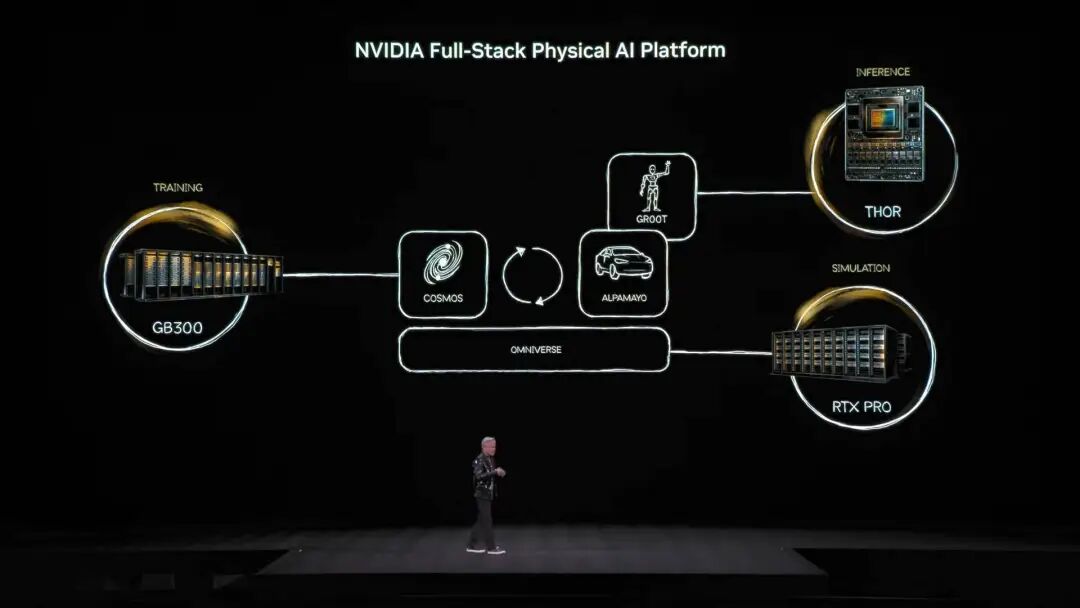

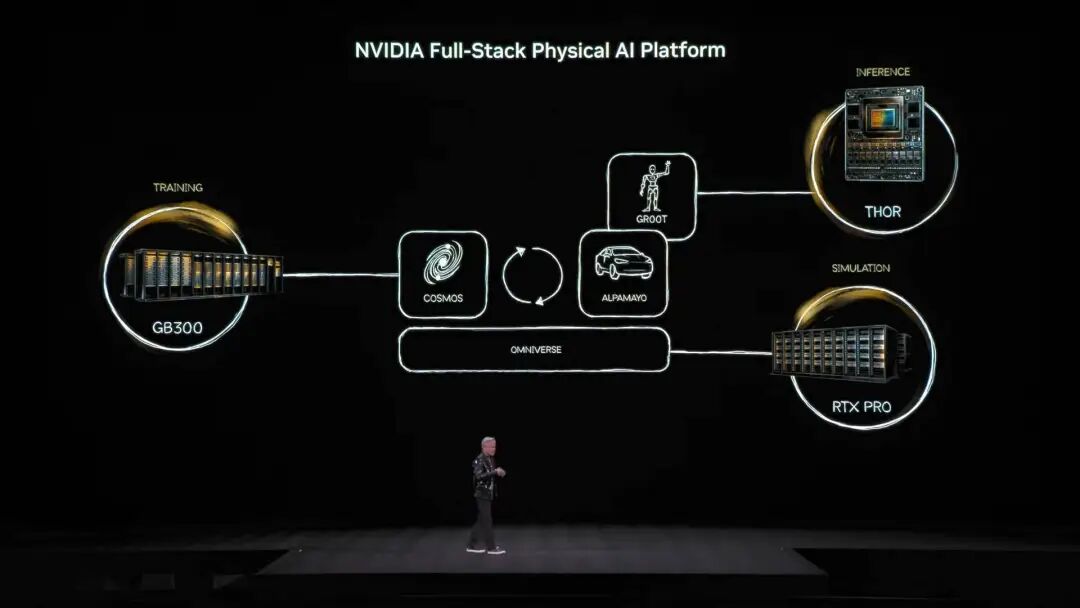

El ecosistema open source de modelos de Nvidia cubre biomedicina, IA física, agentes inteligentes, robótica y conducción autónoma Y la familia de modelos open source Nemotron de Nvidia también fue protagonista de la presentación. Incluye modelos de voz, multimodales, generación aumentada por recuperación y seguridad, y Jensen mencionó que los Nemotron están obteniendo excelentes resultados en los rankings y están siendo adoptados por muchas empresas. ¿Qué es la IA física? Lanzamiento de decenas de modelos en un solo evento Si los grandes modelos de lenguaje solucionan los problemas del “mundo digital”, la próxima ambición de Nvidia es conquistar el “mundo físico”. Jensen comentó que para que la IA comprenda las leyes físicas y funcione en el mundo real, los datos son extremadamente escasos. Además del modelo de agente open source Nemotron, propuso una arquitectura central de “tres computadoras” para construir IA física (Physical AI).

La computadora de entrenamiento: la clásica construida con placas de entrenamiento, como la arquitectura GB300 en la imagen.

La computadora de inferencia: el “cerebelo” en el borde de robots o autos, ejecutando tareas en tiempo real.

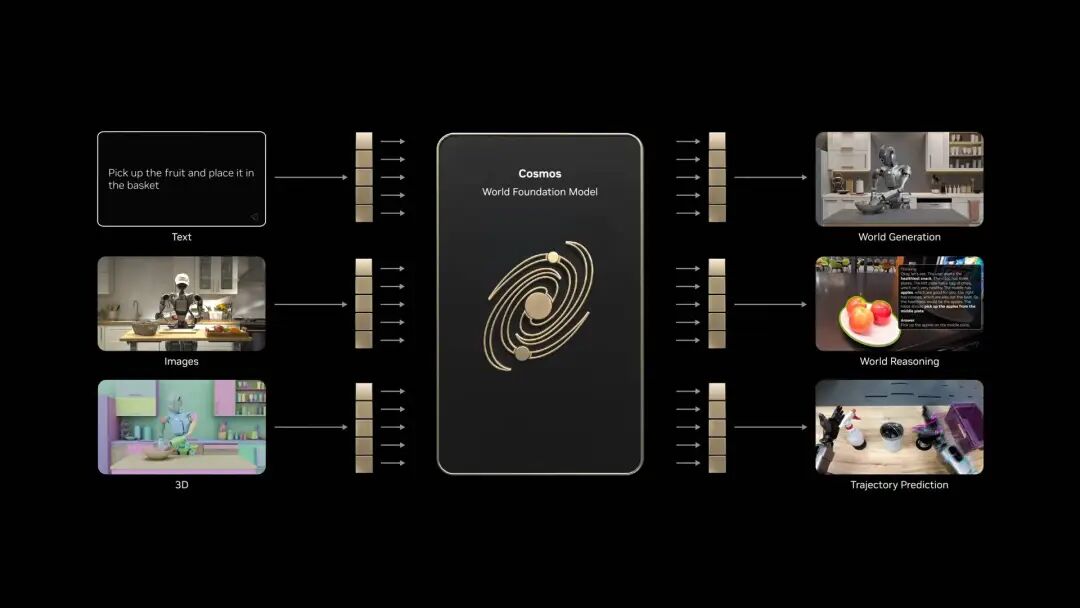

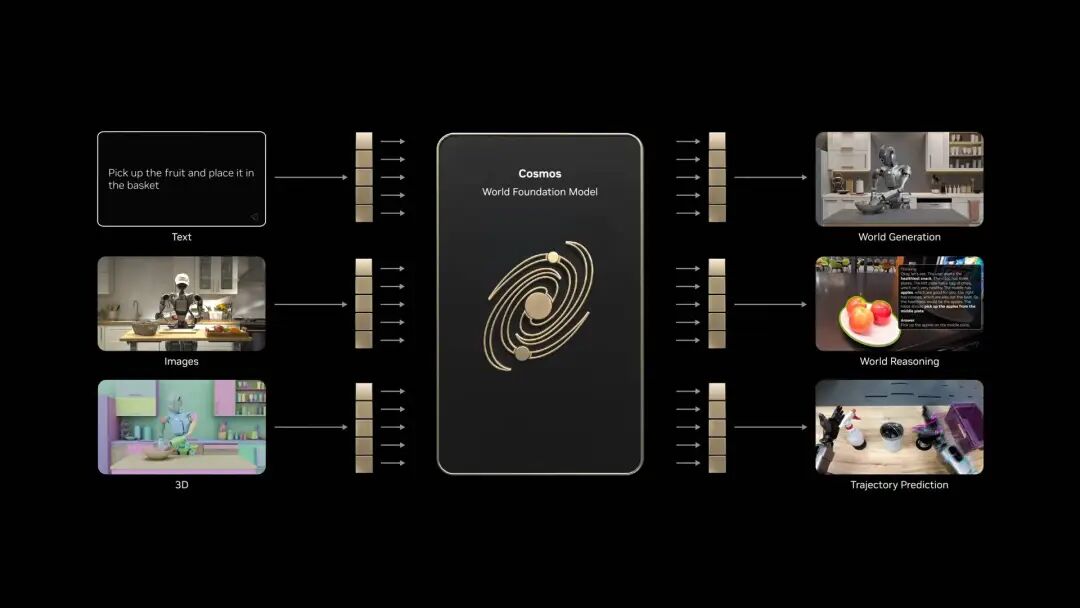

La computadora de simulación: plataformas como Omniverse y Cosmos, que dan a la IA un entorno virtual para aprender respuestas físicas en simulación. El sistema Cosmos puede generar gran cantidad de entornos de entrenamiento IA del mundo físico Sobre esta base, Jensen Huang presentó Alpamayo, el primer modelo de conducción autónoma del mundo con capacidad de razonamiento y pensamiento.

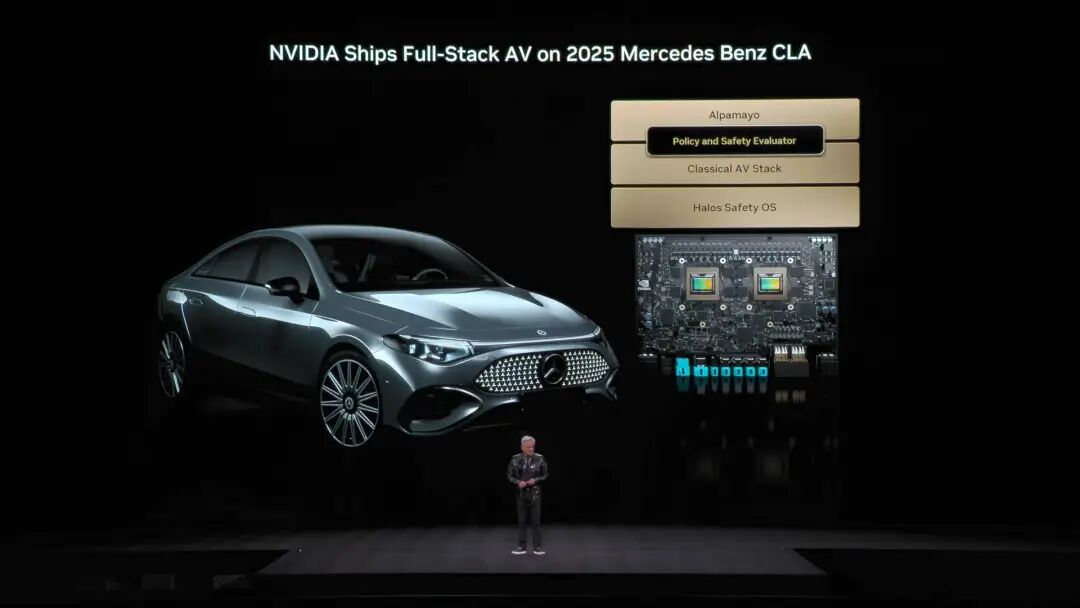

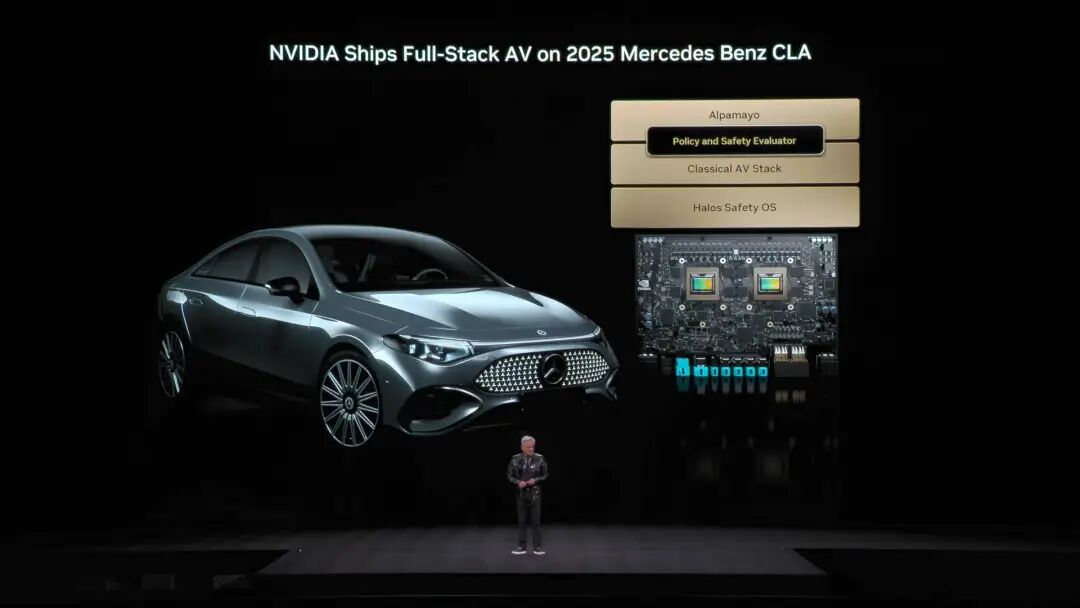

El sistema Cosmos puede generar gran cantidad de entornos de entrenamiento IA del mundo físico Sobre esta base, Jensen Huang presentó Alpamayo, el primer modelo de conducción autónoma del mundo con capacidad de razonamiento y pensamiento.  A diferencia de los sistemas tradicionales, Alpamayo es de entrenamiento end-to-end. Su avance está en resolver el “problema de la cola larga” de la conducción autónoma. Frente a situaciones viales nunca vistas, Alpamayo no ejecuta código rígido sino que razona como un conductor humano. “Te dirá qué va a hacer y por qué toma esa decisión”. En la demo, el estilo de conducción era sorprendentemente natural, descomponiendo escenarios complejos en sentido común básico. Y no es solo una demo: Jensen anunció que el Mercedes CLA equipado con Alpamayo saldrá al mercado estadounidense este primer trimestre, seguido de Europa y Asia.

A diferencia de los sistemas tradicionales, Alpamayo es de entrenamiento end-to-end. Su avance está en resolver el “problema de la cola larga” de la conducción autónoma. Frente a situaciones viales nunca vistas, Alpamayo no ejecuta código rígido sino que razona como un conductor humano. “Te dirá qué va a hacer y por qué toma esa decisión”. En la demo, el estilo de conducción era sorprendentemente natural, descomponiendo escenarios complejos en sentido común básico. Y no es solo una demo: Jensen anunció que el Mercedes CLA equipado con Alpamayo saldrá al mercado estadounidense este primer trimestre, seguido de Europa y Asia.  Este auto fue calificado por NCAP como el más seguro del mundo, gracias al exclusivo sistema de “doble pila de seguridad” de Nvidia. Si el modelo IA end-to-end no tiene suficiente confianza en la situación vial, el sistema vuelve automáticamente a un modo tradicional y más seguro para garantizar la seguridad absoluta. En la presentación, Jensen también mostró la estrategia de robótica de Nvidia.

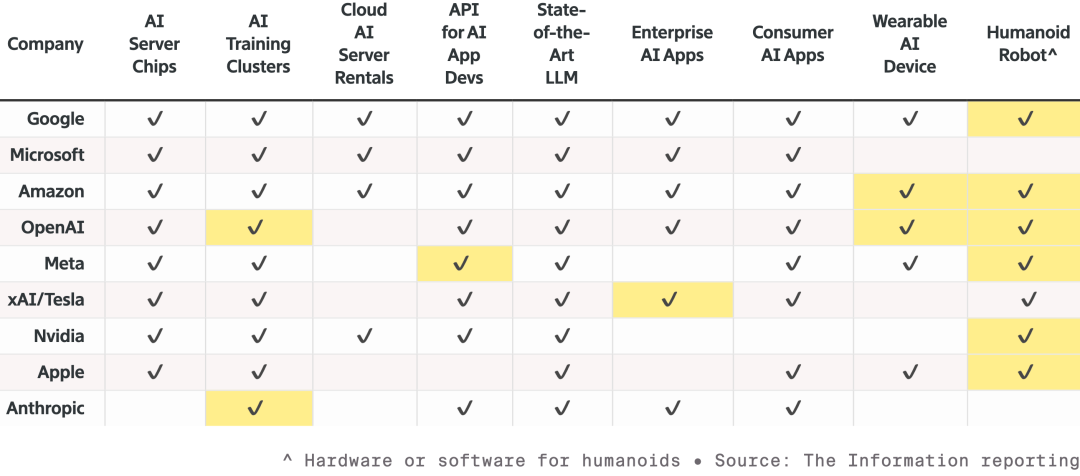

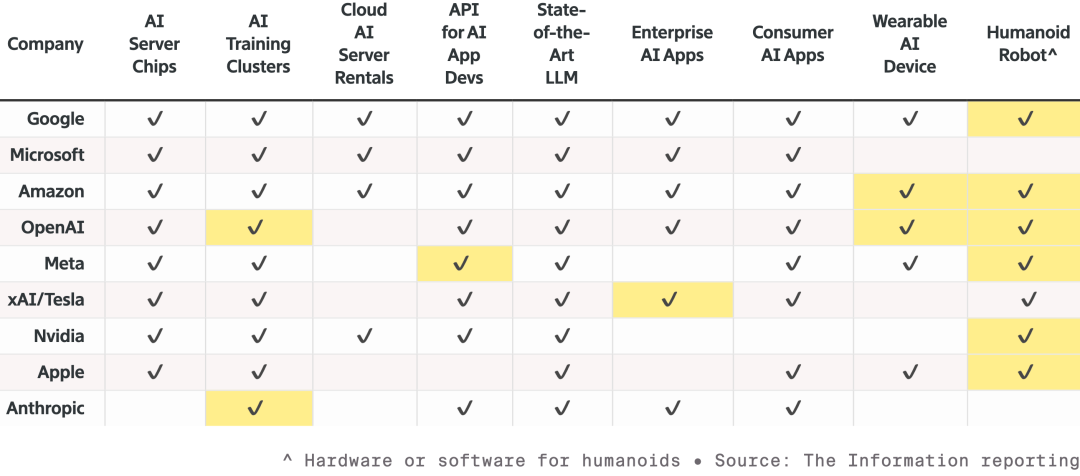

Este auto fue calificado por NCAP como el más seguro del mundo, gracias al exclusivo sistema de “doble pila de seguridad” de Nvidia. Si el modelo IA end-to-end no tiene suficiente confianza en la situación vial, el sistema vuelve automáticamente a un modo tradicional y más seguro para garantizar la seguridad absoluta. En la presentación, Jensen también mostró la estrategia de robótica de Nvidia.  La competencia entre los nueve principales fabricantes de IA y hardware relacionados se está intensificando, todos expanden su línea de robots, con las celdas resaltadas indicando nuevos productos desde el año pasado Todos los robots vendrán equipados con la mini computadora Jetson, serán entrenados en el simulador Isaac de la plataforma Omniverse y Nvidia está integrando esta tecnología a sistemas industriales como Synopsys, Cadence y Siemens.

La competencia entre los nueve principales fabricantes de IA y hardware relacionados se está intensificando, todos expanden su línea de robots, con las celdas resaltadas indicando nuevos productos desde el año pasado Todos los robots vendrán equipados con la mini computadora Jetson, serán entrenados en el simulador Isaac de la plataforma Omniverse y Nvidia está integrando esta tecnología a sistemas industriales como Synopsys, Cadence y Siemens.  Jensen invitó al escenario a robots humanoides y cuadrúpedos, como los de Boston Dynamics y Agility, subrayando que la mayor máquina es la fábrica misma De abajo arriba, la visión de Nvidia es que el futuro del diseño de chips, sistemas y simulación de fábricas será acelerado por la IA física de Nvidia. En la presentación apareció de nuevo el robot de Disney, y Jensen bromeó con los simpáticos robots: “Van a ser diseñados en computadoras, fabricados en computadoras e incluso probados y validados en computadoras antes de enfrentarse a la gravedad real”.

Jensen invitó al escenario a robots humanoides y cuadrúpedos, como los de Boston Dynamics y Agility, subrayando que la mayor máquina es la fábrica misma De abajo arriba, la visión de Nvidia es que el futuro del diseño de chips, sistemas y simulación de fábricas será acelerado por la IA física de Nvidia. En la presentación apareció de nuevo el robot de Disney, y Jensen bromeó con los simpáticos robots: “Van a ser diseñados en computadoras, fabricados en computadoras e incluso probados y validados en computadoras antes de enfrentarse a la gravedad real”.  Si no supieras que es Jensen Huang, toda la charla parecería la presentación de una empresa de modelos de IA. En tiempos donde se habla mucho de la “burbuja IA”, aparte de la desaceleración de la Ley de Moore, Jensen también necesita demostrar de qué es capaz la IA para renovar la fe en ella. Además de presentar el nuevo supercomputador de IA Vera Rubin para calmar el hambre de cómputo, dedicó más esfuerzo que nunca a aplicaciones y software, mostrando al máximo los cambios tangibles que traerá la IA. Como él mismo dijo, antes hacían chips para el mundo virtual, ahora también bajan a la cancha para mostrar IA física, enfocándose en la conducción autónoma y la robótica, entrando así a la competencia real del mundo físico. Al fin y al cabo, solo si hay guerra, se puede seguir vendiendo armas. *Por último, el video sorpresa: Por falta de tiempo en la charla del CES, Jensen no alcanzó a mostrar muchas diapositivas. Así que las convirtió en un video divertido. Disfrutá⬇️

Si no supieras que es Jensen Huang, toda la charla parecería la presentación de una empresa de modelos de IA. En tiempos donde se habla mucho de la “burbuja IA”, aparte de la desaceleración de la Ley de Moore, Jensen también necesita demostrar de qué es capaz la IA para renovar la fe en ella. Además de presentar el nuevo supercomputador de IA Vera Rubin para calmar el hambre de cómputo, dedicó más esfuerzo que nunca a aplicaciones y software, mostrando al máximo los cambios tangibles que traerá la IA. Como él mismo dijo, antes hacían chips para el mundo virtual, ahora también bajan a la cancha para mostrar IA física, enfocándose en la conducción autónoma y la robótica, entrando así a la competencia real del mundo físico. Al fin y al cabo, solo si hay guerra, se puede seguir vendiendo armas. *Por último, el video sorpresa: Por falta de tiempo en la charla del CES, Jensen no alcanzó a mostrar muchas diapositivas. Así que las convirtió en un video divertido. Disfrutá⬇️

A diferencia de la charla magistral en solitario del año pasado, en 2026 Jensen Huang estuvo a full de eventos. De NVIDIA Live al diálogo sobre IA industrial con Siemens y luego al Lenovo TechWorld, participando en tres actividades en 48 horas. La última vez, presentó la serie de tarjetas gráficas RTX 50 en el CES. Pero esta vez, la IA física, la robótica y una “ bomba nuclear de nivel empresarial ” se convirtieron en los verdaderos protagonistas. Debuta la plataforma de cómputo Vera Rubin: mientras más compras, más ahorras Durante la presentación, el siempre creativo Jensen subió al escenario un rack de servidor de IA de 2,5 toneladas, lo que sirvió de introducción al foco del evento: la plataforma de cómputo Vera Rubin, nombrada en honor a la astrónoma que descubrió la materia oscura, con un único objetivo: Acelerar la velocidad de entrenamiento de IA y adelantar la llegada de la próxima generación de modelos.

A diferencia de la charla magistral en solitario del año pasado, en 2026 Jensen Huang estuvo a full de eventos. De NVIDIA Live al diálogo sobre IA industrial con Siemens y luego al Lenovo TechWorld, participando en tres actividades en 48 horas. La última vez, presentó la serie de tarjetas gráficas RTX 50 en el CES. Pero esta vez, la IA física, la robótica y una “ bomba nuclear de nivel empresarial ” se convirtieron en los verdaderos protagonistas. Debuta la plataforma de cómputo Vera Rubin: mientras más compras, más ahorras Durante la presentación, el siempre creativo Jensen subió al escenario un rack de servidor de IA de 2,5 toneladas, lo que sirvió de introducción al foco del evento: la plataforma de cómputo Vera Rubin, nombrada en honor a la astrónoma que descubrió la materia oscura, con un único objetivo: Acelerar la velocidad de entrenamiento de IA y adelantar la llegada de la próxima generación de modelos.  Normalmente, en Nvidia hay una regla interna: cada generación de productos solo cambia un máximo de 1-2 chips. Pero esta vez, Vera Rubin rompió la regla y rediseñó de una sola vez 6 chips, los cuales ya están en plena producción masiva.

Normalmente, en Nvidia hay una regla interna: cada generación de productos solo cambia un máximo de 1-2 chips. Pero esta vez, Vera Rubin rompió la regla y rediseñó de una sola vez 6 chips, los cuales ya están en plena producción masiva. ¿La razón? Con la desaceleración de la Ley de Moore, las formas tradicionales de mejorar el rendimiento ya no siguen el ritmo del crecimiento exponencial anual de los modelos de IA, así que Nvidia apostó por el “diseño colaborativo extremo”: innovando en todos los chips y en todos los niveles de la plataforma al mismo tiempo.

Estos 6 chips son: 1. Vera CPU: - 88 núcleos Olympus personalizados de NVIDIA - Tecnología de multihilo espacial de NVIDIA, soporta 176 hilos - Ancho de banda NVLink C2C de 1,8 TB/s - Memoria del sistema de 1,5 TB (3 veces la de Grace) - Ancho de banda LPDDR5X de 1,2 TB/s - 227 mil millones de transistores

Estos 6 chips son: 1. Vera CPU: - 88 núcleos Olympus personalizados de NVIDIA - Tecnología de multihilo espacial de NVIDIA, soporta 176 hilos - Ancho de banda NVLink C2C de 1,8 TB/s - Memoria del sistema de 1,5 TB (3 veces la de Grace) - Ancho de banda LPDDR5X de 1,2 TB/s - 227 mil millones de transistores  2. Rubin GPU: - 50 PFLOPS de inferencia NVFP4, 5 veces más que la generación anterior Blackwell - 336 mil millones de transistores, 1,6 veces más que Blackwell - Tercera generación del motor Transformer, que ajusta la precisión dinámicamente según el modelo Transformer

2. Rubin GPU: - 50 PFLOPS de inferencia NVFP4, 5 veces más que la generación anterior Blackwell - 336 mil millones de transistores, 1,6 veces más que Blackwell - Tercera generación del motor Transformer, que ajusta la precisión dinámicamente según el modelo Transformer  3. Placa de red ConnectX-9: - Ethernet de 800 Gb/s basada en 200G PAM4 SerDes - RDMA programable y acelerador de ruta de datos - Certificaciones CNSA y FIPS - 23 mil millones de transistores

3. Placa de red ConnectX-9: - Ethernet de 800 Gb/s basada en 200G PAM4 SerDes - RDMA programable y acelerador de ruta de datos - Certificaciones CNSA y FIPS - 23 mil millones de transistores  4. BlueField-4 DPU: - Motor de extremo a extremo diseñado para la nueva generación de plataformas de almacenamiento IA - DPU de 800G Gb/s para SmartNIC y procesadores de almacenamiento - CPU Grace de 64 núcleos junto a ConnectX-9 - 126 mil millones de transistores

4. BlueField-4 DPU: - Motor de extremo a extremo diseñado para la nueva generación de plataformas de almacenamiento IA - DPU de 800G Gb/s para SmartNIC y procesadores de almacenamiento - CPU Grace de 64 núcleos junto a ConnectX-9 - 126 mil millones de transistores  5. Chip de conmutación NVLink-6: - Conecta 18 nodos de cómputo, soporta hasta 72 GPUs Rubin funcionando como un solo conjunto - En la arquitectura NVLink 6, cada GPU puede alcanzar 3,6 TB por segundo de ancho de banda all-to-all - Usa 400G SerDes, soporta In-Network SHARP Collectives, permitiendo operaciones colectivas dentro de la red de switches

5. Chip de conmutación NVLink-6: - Conecta 18 nodos de cómputo, soporta hasta 72 GPUs Rubin funcionando como un solo conjunto - En la arquitectura NVLink 6, cada GPU puede alcanzar 3,6 TB por segundo de ancho de banda all-to-all - Usa 400G SerDes, soporta In-Network SHARP Collectives, permitiendo operaciones colectivas dentro de la red de switches  6. Chip de conmutación óptica Spectrum-6 Ethernet - 512 canales, 200Gbps por canal, para una transmisión de datos ultra rápida - Tecnología de silicio fotónico con proceso COOP de TSMC - Interfaz óptica copackaged - 352 mil millones de transistores

6. Chip de conmutación óptica Spectrum-6 Ethernet - 512 canales, 200Gbps por canal, para una transmisión de datos ultra rápida - Tecnología de silicio fotónico con proceso COOP de TSMC - Interfaz óptica copackaged - 352 mil millones de transistores  Gracias a la integración profunda de estos 6 chips, el sistema Vera Rubin NVL72 supera en todos los aspectos a la generación anterior Blackwell. En tareas de inferencia NVFP4, este chip alcanzó 3,6 EFLOPS, 5 veces más que la arquitectura Blackwell previa. En entrenamiento NVFP4, el rendimiento llegó a 2,5 EFLOPS, un aumento de 3,5 veces. En cuanto a capacidad de almacenamiento, NVL72 cuenta con 54TB de memoria LPDDR5X, 3 veces más que la generación anterior. La memoria HBM (de alto ancho de banda) alcanza los 20,7TB, un 50% más. En ancho de banda, HBM4 alcanza 1,6 PB/s, un aumento de 2,8 veces; el ancho de banda Scale-Up llega a 260 TB/s, duplicando la cifra anterior. A pesar de este salto en el rendimiento, la cantidad de transistores solo aumentó 1,7 veces, llegando a 220 billones, demostrando la innovación en la tecnología de fabricación de semiconductores.

Gracias a la integración profunda de estos 6 chips, el sistema Vera Rubin NVL72 supera en todos los aspectos a la generación anterior Blackwell. En tareas de inferencia NVFP4, este chip alcanzó 3,6 EFLOPS, 5 veces más que la arquitectura Blackwell previa. En entrenamiento NVFP4, el rendimiento llegó a 2,5 EFLOPS, un aumento de 3,5 veces. En cuanto a capacidad de almacenamiento, NVL72 cuenta con 54TB de memoria LPDDR5X, 3 veces más que la generación anterior. La memoria HBM (de alto ancho de banda) alcanza los 20,7TB, un 50% más. En ancho de banda, HBM4 alcanza 1,6 PB/s, un aumento de 2,8 veces; el ancho de banda Scale-Up llega a 260 TB/s, duplicando la cifra anterior. A pesar de este salto en el rendimiento, la cantidad de transistores solo aumentó 1,7 veces, llegando a 220 billones, demostrando la innovación en la tecnología de fabricación de semiconductores.  En diseño de ingeniería, Vera Rubin también trajo avances importantes. Antes, cada nodo de supercomputadora necesitaba 43 cables y dos horas de ensamblaje, con alto riesgo de errores. Ahora, el nodo Vera Rubin usa cero cables, solo 6 tubos de refrigeración líquida, y se arma en 5 minutos. Más impresionante aún: la parte trasera del rack está llena de casi 3,2 km de cable de cobre, 5.000 cables formando la red troncal NVLink, alcanzando 400Gbps de velocidad. Según Jensen: “Puede que pese cientos de libras, tenés que ser un CEO bastante fuerte para este trabajo”. En el mundo de la IA, el tiempo es dinero. Un dato clave: para entrenar un modelo de 10 billones de parámetros, Rubin necesita solo una cuarta parte de los sistemas Blackwell y el costo por token generado es un décimo del de Blackwell.

En diseño de ingeniería, Vera Rubin también trajo avances importantes. Antes, cada nodo de supercomputadora necesitaba 43 cables y dos horas de ensamblaje, con alto riesgo de errores. Ahora, el nodo Vera Rubin usa cero cables, solo 6 tubos de refrigeración líquida, y se arma en 5 minutos. Más impresionante aún: la parte trasera del rack está llena de casi 3,2 km de cable de cobre, 5.000 cables formando la red troncal NVLink, alcanzando 400Gbps de velocidad. Según Jensen: “Puede que pese cientos de libras, tenés que ser un CEO bastante fuerte para este trabajo”. En el mundo de la IA, el tiempo es dinero. Un dato clave: para entrenar un modelo de 10 billones de parámetros, Rubin necesita solo una cuarta parte de los sistemas Blackwell y el costo por token generado es un décimo del de Blackwell.  Además, aunque el consumo de Rubin es el doble que el de Grace Blackwell, el rendimiento supera ampliamente ese aumento: 5 veces más en inferencia, 3,5 veces más en entrenamiento. Aún más importante, Rubin aumenta el throughput (tokens de IA por watt por dólar) 10 veces respecto a Blackwell. Para un datacenter de gigavatios que cuesta 50.000 millones de dólares, esto puede significar duplicar la capacidad de generación de ingresos. Hasta ahora, el mayor problema de la industria IA era la falta de memoria contextual. En concreto, la IA genera un “KV Cache” (memoria clave-valor), algo así como su “memoria de trabajo”. El problema es que, a medida que las conversaciones se alargan y los modelos crecen, la memoria HBM se queda corta.

Además, aunque el consumo de Rubin es el doble que el de Grace Blackwell, el rendimiento supera ampliamente ese aumento: 5 veces más en inferencia, 3,5 veces más en entrenamiento. Aún más importante, Rubin aumenta el throughput (tokens de IA por watt por dólar) 10 veces respecto a Blackwell. Para un datacenter de gigavatios que cuesta 50.000 millones de dólares, esto puede significar duplicar la capacidad de generación de ingresos. Hasta ahora, el mayor problema de la industria IA era la falta de memoria contextual. En concreto, la IA genera un “KV Cache” (memoria clave-valor), algo así como su “memoria de trabajo”. El problema es que, a medida que las conversaciones se alargan y los modelos crecen, la memoria HBM se queda corta.  El año pasado Nvidia amplió la memoria con la arquitectura Grace-Blackwell, pero tampoco fue suficiente. Vera Rubin soluciona esto instalando procesadores BlueField-4 en el rack, dedicados a gestionar el KV Cache. Cada nodo tiene 4 BlueField-4, cada uno con 150TB de memoria contextual, que se reparte a las GPUs. Así, cada GPU recibe 16TB extra de memoria, cuando la interna es solo de 1TB, y lo mejor, el ancho de banda se mantiene en 200Gbps sin sacrificar velocidad. Pero no basta con capacidad: para que las “notas adhesivas” distribuidas en decenas de racks y miles de GPUs trabajen como una sola memoria, la red debe ser “suficientemente grande, rápida y estable”. Ahí entra Spectrum-X. Spectrum-X es la primera plataforma Ethernet de punta a punta del mundo “diseñada para IA generativa”. La nueva generación usa tecnología COOP de TSMC, integra silicio fotónico y ofrece 512 canales a 200Gbps cada uno. Jensen hizo la cuenta: un datacenter de 1GW cuesta 50.000 millones de dólares, y Spectrum-X puede aumentar el throughput en un 25%, ahorrando 5.000 millones. “Podés decir que este sistema de red es prácticamente gratis”. En seguridad, Vera Rubin soporta Confidential Computing. Todos los datos están encriptados durante transmisión, almacenamiento y computación, incluyendo los buses PCIe, NVLink y CPU-GPU. Las empresas pueden desplegar sus modelos en sistemas externos sin temor a fugas de datos. DeepSeek sorprendió al mundo: la comunidad open source y los agentes inteligentes son la corriente principal de la IA Terminada la parte fuerte, volvamos al inicio de la charla. Apenas subió al escenario, Jensen Huang lanzó una cifra impactante: unos 10 billones de dólares invertidos en recursos de cómputo en la última década están siendo completamente modernizados. Pero esto no es solo una actualización de hardware, sino un cambio de paradigma de software. Habló especialmente de los modelos de agentes inteligentes (Agentic), mencionando a Cursor, que cambió radicalmente la programación interna de Nvidia.

El año pasado Nvidia amplió la memoria con la arquitectura Grace-Blackwell, pero tampoco fue suficiente. Vera Rubin soluciona esto instalando procesadores BlueField-4 en el rack, dedicados a gestionar el KV Cache. Cada nodo tiene 4 BlueField-4, cada uno con 150TB de memoria contextual, que se reparte a las GPUs. Así, cada GPU recibe 16TB extra de memoria, cuando la interna es solo de 1TB, y lo mejor, el ancho de banda se mantiene en 200Gbps sin sacrificar velocidad. Pero no basta con capacidad: para que las “notas adhesivas” distribuidas en decenas de racks y miles de GPUs trabajen como una sola memoria, la red debe ser “suficientemente grande, rápida y estable”. Ahí entra Spectrum-X. Spectrum-X es la primera plataforma Ethernet de punta a punta del mundo “diseñada para IA generativa”. La nueva generación usa tecnología COOP de TSMC, integra silicio fotónico y ofrece 512 canales a 200Gbps cada uno. Jensen hizo la cuenta: un datacenter de 1GW cuesta 50.000 millones de dólares, y Spectrum-X puede aumentar el throughput en un 25%, ahorrando 5.000 millones. “Podés decir que este sistema de red es prácticamente gratis”. En seguridad, Vera Rubin soporta Confidential Computing. Todos los datos están encriptados durante transmisión, almacenamiento y computación, incluyendo los buses PCIe, NVLink y CPU-GPU. Las empresas pueden desplegar sus modelos en sistemas externos sin temor a fugas de datos. DeepSeek sorprendió al mundo: la comunidad open source y los agentes inteligentes son la corriente principal de la IA Terminada la parte fuerte, volvamos al inicio de la charla. Apenas subió al escenario, Jensen Huang lanzó una cifra impactante: unos 10 billones de dólares invertidos en recursos de cómputo en la última década están siendo completamente modernizados. Pero esto no es solo una actualización de hardware, sino un cambio de paradigma de software. Habló especialmente de los modelos de agentes inteligentes (Agentic), mencionando a Cursor, que cambió radicalmente la programación interna de Nvidia.  Lo que más entusiasmó al público fue su gran valoración de la comunidad open source. Jensen fue directo: el avance de DeepSeek V1 sorprendió a todo el mundo; como primer sistema de inferencia open source, impulsó el desarrollo de todo el sector. En la PPT, los modelos chinos Kimi k2 y DeepSeek V3.2 eran primero y segundo en open source. Según Jensen Huang, aunque los modelos open source hoy estén unos seis meses detrás de los top, cada seis meses aparece uno nuevo. Esta velocidad de iteración atrae tanto a startups, gigantes y académicos, incluyendo a Nvidia. Por eso, esta vez no solo vendieron palas y tarjetas gráficas; Nvidia construyó la supercomputadora DGX Cloud, valuada en miles de millones de dólares, y desarrolló modelos de vanguardia como La Proteina (síntesis de proteínas) y OpenFold 3.

Lo que más entusiasmó al público fue su gran valoración de la comunidad open source. Jensen fue directo: el avance de DeepSeek V1 sorprendió a todo el mundo; como primer sistema de inferencia open source, impulsó el desarrollo de todo el sector. En la PPT, los modelos chinos Kimi k2 y DeepSeek V3.2 eran primero y segundo en open source. Según Jensen Huang, aunque los modelos open source hoy estén unos seis meses detrás de los top, cada seis meses aparece uno nuevo. Esta velocidad de iteración atrae tanto a startups, gigantes y académicos, incluyendo a Nvidia. Por eso, esta vez no solo vendieron palas y tarjetas gráficas; Nvidia construyó la supercomputadora DGX Cloud, valuada en miles de millones de dólares, y desarrolló modelos de vanguardia como La Proteina (síntesis de proteínas) y OpenFold 3.  El ecosistema open source de modelos de Nvidia cubre biomedicina, IA física, agentes inteligentes, robótica y conducción autónoma Y la familia de modelos open source Nemotron de Nvidia también fue protagonista de la presentación. Incluye modelos de voz, multimodales, generación aumentada por recuperación y seguridad, y Jensen mencionó que los Nemotron están obteniendo excelentes resultados en los rankings y están siendo adoptados por muchas empresas. ¿Qué es la IA física? Lanzamiento de decenas de modelos en un solo evento Si los grandes modelos de lenguaje solucionan los problemas del “mundo digital”, la próxima ambición de Nvidia es conquistar el “mundo físico”. Jensen comentó que para que la IA comprenda las leyes físicas y funcione en el mundo real, los datos son extremadamente escasos. Además del modelo de agente open source Nemotron, propuso una arquitectura central de “tres computadoras” para construir IA física (Physical AI).

El ecosistema open source de modelos de Nvidia cubre biomedicina, IA física, agentes inteligentes, robótica y conducción autónoma Y la familia de modelos open source Nemotron de Nvidia también fue protagonista de la presentación. Incluye modelos de voz, multimodales, generación aumentada por recuperación y seguridad, y Jensen mencionó que los Nemotron están obteniendo excelentes resultados en los rankings y están siendo adoptados por muchas empresas. ¿Qué es la IA física? Lanzamiento de decenas de modelos en un solo evento Si los grandes modelos de lenguaje solucionan los problemas del “mundo digital”, la próxima ambición de Nvidia es conquistar el “mundo físico”. Jensen comentó que para que la IA comprenda las leyes físicas y funcione en el mundo real, los datos son extremadamente escasos. Además del modelo de agente open source Nemotron, propuso una arquitectura central de “tres computadoras” para construir IA física (Physical AI).

La computadora de entrenamiento: la clásica construida con placas de entrenamiento, como la arquitectura GB300 en la imagen.

La computadora de inferencia: el “cerebelo” en el borde de robots o autos, ejecutando tareas en tiempo real.

La computadora de simulación: plataformas como Omniverse y Cosmos, que dan a la IA un entorno virtual para aprender respuestas físicas en simulación.

El sistema Cosmos puede generar gran cantidad de entornos de entrenamiento IA del mundo físico Sobre esta base, Jensen Huang presentó Alpamayo, el primer modelo de conducción autónoma del mundo con capacidad de razonamiento y pensamiento.

El sistema Cosmos puede generar gran cantidad de entornos de entrenamiento IA del mundo físico Sobre esta base, Jensen Huang presentó Alpamayo, el primer modelo de conducción autónoma del mundo con capacidad de razonamiento y pensamiento.  A diferencia de los sistemas tradicionales, Alpamayo es de entrenamiento end-to-end. Su avance está en resolver el “problema de la cola larga” de la conducción autónoma. Frente a situaciones viales nunca vistas, Alpamayo no ejecuta código rígido sino que razona como un conductor humano. “Te dirá qué va a hacer y por qué toma esa decisión”. En la demo, el estilo de conducción era sorprendentemente natural, descomponiendo escenarios complejos en sentido común básico. Y no es solo una demo: Jensen anunció que el Mercedes CLA equipado con Alpamayo saldrá al mercado estadounidense este primer trimestre, seguido de Europa y Asia.

A diferencia de los sistemas tradicionales, Alpamayo es de entrenamiento end-to-end. Su avance está en resolver el “problema de la cola larga” de la conducción autónoma. Frente a situaciones viales nunca vistas, Alpamayo no ejecuta código rígido sino que razona como un conductor humano. “Te dirá qué va a hacer y por qué toma esa decisión”. En la demo, el estilo de conducción era sorprendentemente natural, descomponiendo escenarios complejos en sentido común básico. Y no es solo una demo: Jensen anunció que el Mercedes CLA equipado con Alpamayo saldrá al mercado estadounidense este primer trimestre, seguido de Europa y Asia.  Este auto fue calificado por NCAP como el más seguro del mundo, gracias al exclusivo sistema de “doble pila de seguridad” de Nvidia. Si el modelo IA end-to-end no tiene suficiente confianza en la situación vial, el sistema vuelve automáticamente a un modo tradicional y más seguro para garantizar la seguridad absoluta. En la presentación, Jensen también mostró la estrategia de robótica de Nvidia.

Este auto fue calificado por NCAP como el más seguro del mundo, gracias al exclusivo sistema de “doble pila de seguridad” de Nvidia. Si el modelo IA end-to-end no tiene suficiente confianza en la situación vial, el sistema vuelve automáticamente a un modo tradicional y más seguro para garantizar la seguridad absoluta. En la presentación, Jensen también mostró la estrategia de robótica de Nvidia.  La competencia entre los nueve principales fabricantes de IA y hardware relacionados se está intensificando, todos expanden su línea de robots, con las celdas resaltadas indicando nuevos productos desde el año pasado Todos los robots vendrán equipados con la mini computadora Jetson, serán entrenados en el simulador Isaac de la plataforma Omniverse y Nvidia está integrando esta tecnología a sistemas industriales como Synopsys, Cadence y Siemens.

La competencia entre los nueve principales fabricantes de IA y hardware relacionados se está intensificando, todos expanden su línea de robots, con las celdas resaltadas indicando nuevos productos desde el año pasado Todos los robots vendrán equipados con la mini computadora Jetson, serán entrenados en el simulador Isaac de la plataforma Omniverse y Nvidia está integrando esta tecnología a sistemas industriales como Synopsys, Cadence y Siemens.  Jensen invitó al escenario a robots humanoides y cuadrúpedos, como los de Boston Dynamics y Agility, subrayando que la mayor máquina es la fábrica misma De abajo arriba, la visión de Nvidia es que el futuro del diseño de chips, sistemas y simulación de fábricas será acelerado por la IA física de Nvidia. En la presentación apareció de nuevo el robot de Disney, y Jensen bromeó con los simpáticos robots: “Van a ser diseñados en computadoras, fabricados en computadoras e incluso probados y validados en computadoras antes de enfrentarse a la gravedad real”.

Jensen invitó al escenario a robots humanoides y cuadrúpedos, como los de Boston Dynamics y Agility, subrayando que la mayor máquina es la fábrica misma De abajo arriba, la visión de Nvidia es que el futuro del diseño de chips, sistemas y simulación de fábricas será acelerado por la IA física de Nvidia. En la presentación apareció de nuevo el robot de Disney, y Jensen bromeó con los simpáticos robots: “Van a ser diseñados en computadoras, fabricados en computadoras e incluso probados y validados en computadoras antes de enfrentarse a la gravedad real”.  Si no supieras que es Jensen Huang, toda la charla parecería la presentación de una empresa de modelos de IA. En tiempos donde se habla mucho de la “burbuja IA”, aparte de la desaceleración de la Ley de Moore, Jensen también necesita demostrar de qué es capaz la IA para renovar la fe en ella. Además de presentar el nuevo supercomputador de IA Vera Rubin para calmar el hambre de cómputo, dedicó más esfuerzo que nunca a aplicaciones y software, mostrando al máximo los cambios tangibles que traerá la IA. Como él mismo dijo, antes hacían chips para el mundo virtual, ahora también bajan a la cancha para mostrar IA física, enfocándose en la conducción autónoma y la robótica, entrando así a la competencia real del mundo físico. Al fin y al cabo, solo si hay guerra, se puede seguir vendiendo armas. *Por último, el video sorpresa: Por falta de tiempo en la charla del CES, Jensen no alcanzó a mostrar muchas diapositivas. Así que las convirtió en un video divertido. Disfrutá⬇️

Si no supieras que es Jensen Huang, toda la charla parecería la presentación de una empresa de modelos de IA. En tiempos donde se habla mucho de la “burbuja IA”, aparte de la desaceleración de la Ley de Moore, Jensen también necesita demostrar de qué es capaz la IA para renovar la fe en ella. Además de presentar el nuevo supercomputador de IA Vera Rubin para calmar el hambre de cómputo, dedicó más esfuerzo que nunca a aplicaciones y software, mostrando al máximo los cambios tangibles que traerá la IA. Como él mismo dijo, antes hacían chips para el mundo virtual, ahora también bajan a la cancha para mostrar IA física, enfocándose en la conducción autónoma y la robótica, entrando así a la competencia real del mundo físico. Al fin y al cabo, solo si hay guerra, se puede seguir vendiendo armas. *Por último, el video sorpresa: Por falta de tiempo en la charla del CES, Jensen no alcanzó a mostrar muchas diapositivas. Así que las convirtió en un video divertido. Disfrutá⬇️

0

0

Descargo de responsabilidad: El contenido de este artículo refleja únicamente la opinión del autor y no representa en modo alguno a la plataforma. Este artículo no se pretende servir de referencia para tomar decisiones de inversión.

PoolX: Haz staking y gana nuevos tokens.

APR de hasta 12%. Gana más airdrop bloqueando más.

¡Bloquea ahora!

También te puede gustar

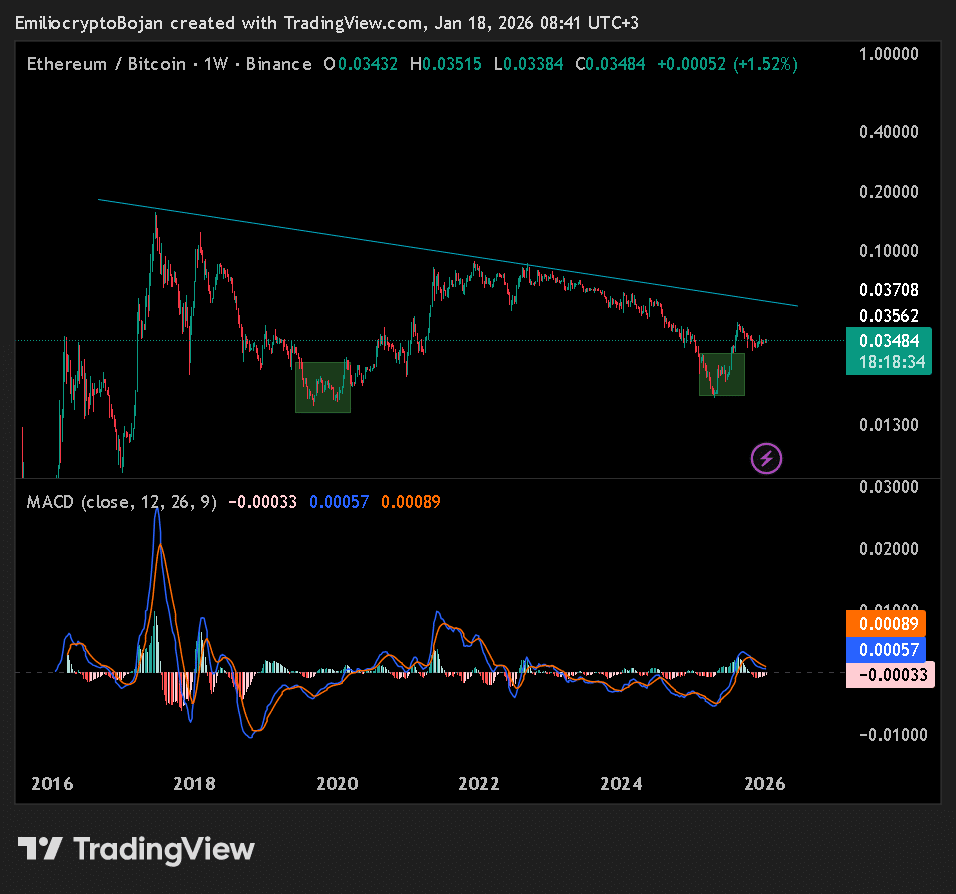

Las altcoins ganan impulso mientras Ethereum lidera: ¿se viene una adopción más amplia?

AMBCrypto•2026/01/18 23:04

Los aranceles de Trump sobre Groenlandia han descarrilado por completo la estrategia de apaciguamiento de la UE.

101 finance•2026/01/18 22:38

El Consejo Europeo convocará conversaciones urgentes sobre los aranceles de Trump y las opciones de represalia de la UE

Cointelegraph•2026/01/18 22:32

En tendencia

MásPrecios de las criptos

MásBitcoin

BTC

$94,969.48

-0.15%

Ethereum

ETH

$3,323.81

+0.57%

Tether USDt

USDT

$0.9997

+0.01%

BNB

BNB

$948.1

+0.15%

XRP

XRP

$2.05

-0.80%

Solana

SOL

$141.84

-1.38%

USDC

USDC

$0.9997

-0.01%

TRON

TRX

$0.3199

+0.40%

Dogecoin

DOGE

$0.1361

-1.21%

Cardano

ADA

$0.3916

-1.18%

Cómo vender PI

PI llega a Bitget. ¡Compra o vende PI rápidamente en Bitget!

Haz trading ahora

¿Aún no eres Bitgetter?¡Un paquete de bienvenida de 6.200 USDT para los nuevos usuarios!

Regístrate ahora