Auteur : Ma Leilei

Source : CHANNELWU de Wu Xiaobo

Buffett a dit un jour : « N'investissez jamais dans une entreprise que vous ne comprenez pas. » Pourtant, alors que « l'ère du dieu de la bourse » touche à sa fin, Buffett a pris une décision qui va à l'encontre de ses « règles familiales » : il a acheté des actions Google, et ce, avec une prime élevée d'environ 40 fois le flux de trésorerie disponible.

Oui, c'est la première fois que Buffett achète des actions liées à l'IA, et ce n'est ni OpenAI, ni Nvidia. Tous les investisseurs se posent la même question : pourquoi Google ?

Revenons à la fin de 2022. À ce moment-là, ChatGPT est apparu soudainement, la direction de Google a déclenché une « alerte rouge », multipliant les réunions, allant même jusqu'à rappeler d'urgence les deux fondateurs. Mais à l'époque, Google ressemblait à un dinosaure lent, englué dans la bureaucratie.

Ils ont lancé à la hâte le chatbot Bard, mais ont commis une erreur factuelle lors de la démonstration, ce qui a fait chuter le cours de l'action et évaporé des centaines de milliards de dollars de capitalisation boursière en une journée. Ensuite, ils ont fusionné leurs équipes IA et lancé le modèle multimodal Gemini1.5.

Mais ce produit, considéré comme leur atout maître, n'a suscité qu'un bref engouement dans le cercle technologique, avant d'être éclipsé par le lancement du modèle de génération vidéo Sora d'OpenAI, tombant rapidement dans l'oubli.

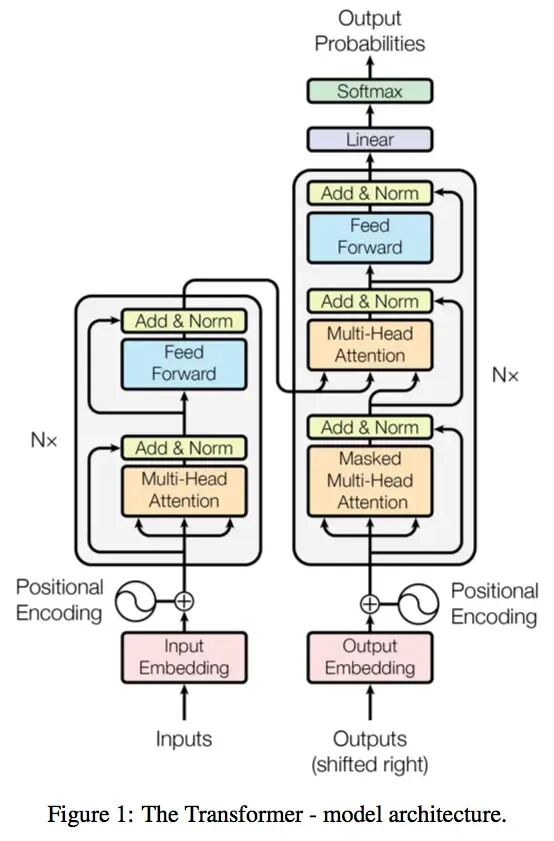

Ce qui est un peu embarrassant, c'est que ce sont justement les chercheurs de Google qui, en 2017, ont publié l'article académique fondateur qui a jeté les bases théoriques solides de cette révolution de l'IA.

L'article « Attention Is All You Need »

Le modèle Transformer proposé

Les concurrents se moquent de Google. Le CEO d'OpenAI, Altman, dédaigne le goût de Google : « Je ne peux m'empêcher de penser à la différence esthétique entre OpenAI et Google. »

L'ancien CEO de Google n'est pas non plus satisfait de la paresse de l'entreprise : « Google a toujours pensé que l'équilibre entre vie professionnelle et vie privée... était plus important que de gagner la compétition. »

Cette série de difficultés a également amené certains à douter que Google soit à la traîne dans la compétition de l'IA.

Mais le changement est enfin arrivé. En novembre, Google a lancé Gemini 3, qui a surpassé ses concurrents, y compris OpenAI, sur la plupart des indicateurs de référence. Plus important encore, Gemini 3 a été entièrement entraîné sur les puces TPU développées en interne par Google, désormais positionnées comme une alternative moins chère aux GPU Nvidia, et désormais massivement vendues à des clients externes.

Google se distingue sur deux fronts : avec la série Gemini 3, il répond frontalement à OpenAI sur le plan logiciel ; sur l'autre front, il défie la domination de longue date de Nvidia sur le plan matériel avec ses puces TPU.

Un coup de pied à OpenAI, un coup de poing à Nvidia.

Altman a ressenti la pression dès le mois dernier, déclarant dans une note interne que Google « pourrait apporter à notre entreprise quelques vents contraires économiques temporaires ». Et cette semaine, après avoir appris que de grands groupes achetaient des puces TPU, Nvidia, dont le cours de l'action a chuté de 7 % en séance, a dû publier une lettre pour rassurer le marché.

Le CEO de Google, Sundar Pichai, a déclaré dans un récent podcast que les employés de Google devraient se reposer un peu. « D'un point de vue externe, nous avons peut-être semblé silencieux ou en retard à cette époque, mais en réalité, nous consolidions toutes les bases et avancions à plein régime sur cette base. »

Aujourd'hui, la situation s'est inversée. Pichai dit : « Nous avons maintenant atteint un point d'inflexion. »

À ce moment-là, cela fait exactement trois ans que ChatGPT a été lancé. En trois ans, l'IA a déclenché un festin de capitaux et d'alliances à la Silicon Valley ; mais sous ce festin, la crainte d'une bulle émerge : le secteur a-t-il atteint un tournant ?

Dépassement

Le 19 novembre, Google a lancé son dernier modèle d'intelligence artificielle, Gemini 3.

Un test a montré que, dans la grande majorité des tests couvrant les connaissances d'experts, le raisonnement logique, les mathématiques et la reconnaissance d'images, Gemini 3 a obtenu des scores nettement supérieurs à ceux des modèles les plus récents d'autres entreprises, y compris ChatGPT. Il n'a été devancé que dans un seul test de programmation, où il s'est classé deuxième.

Le Wall Street Journal a déclaré : « On peut l'appeler le modèle de nouvelle génération le plus avancé des États-Unis. » Bloomberg a dit que Google s'était enfin réveillé. Musk et Altman l'ont beaucoup complimenté. Certains internautes plaisantent en disant que c'est le GPT-5 idéal d'Altman.

Le CEO de Box, une plateforme de gestion de contenu cloud, après avoir testé Gemini 3 en avant-première, a déclaré que l'amélioration des performances était si incroyable qu'ils ont d'abord cru que leur méthode d'évaluation était erronée. Mais après de multiples tests, il a été confirmé que le modèle surpassait tous les autres lors des évaluations internes, avec une avance à deux chiffres.

Le CEO de Salesforce a déclaré qu'il utilisait ChatGPT depuis trois ans, mais que Gemini 3 avait bouleversé sa vision en seulement deux heures : « Holy shit... impossible de revenir en arrière. C'est un saut qualitatif, le raisonnement, la vitesse, le traitement texte-image-vidéo... tout est plus pointu, plus rapide. On a l'impression que le monde a encore une fois été bouleversé. »

Gemini 3

Pourquoi Gemini 3 est-il si performant, et qu'a fait Google ?

Le responsable du projet Gemini a posté : « Simple : amélioration du pré-entraînement et du post-entraînement. » Certains analystes expliquent que le pré-entraînement du modèle suit toujours la logique de la Scaling Law — en optimisant le pré-entraînement (par exemple, des données à plus grande échelle, des méthodes d'entraînement plus efficaces, plus de paramètres, etc.), on améliore les capacités du modèle.

La personne la plus désireuse de connaître le secret de Gemini 3 est sans doute Altman.

Le mois dernier, avant la sortie de Gemini 3, il avait déjà préparé le terrain dans une note interne à l'attention des employés d'OpenAI : « Sous tous les angles, le travail récent de Google est excellent », notamment en matière de pré-entraînement, où les progrès de Google pourraient « apporter à l'entreprise quelques vents contraires économiques temporaires », et « l'ambiance extérieure sera assez difficile dans un avenir proche ».

Bien que, en termes de nombre d'utilisateurs, ChatGPT ait encore un avantage significatif sur Gemini, l'écart se réduit.

En trois ans, le nombre d'utilisateurs de ChatGPT a connu une croissance fulgurante. En février de cette année, il comptait 400 millions d'utilisateurs actifs hebdomadaires, et ce mois-ci, il est passé à 800 millions. Gemini a publié des chiffres d'utilisateurs actifs mensuels : en juillet, il en comptait 450 millions, et ce mois-ci, il est passé à 650 millions.

Avec environ 90 % de part de marché dans la recherche en ligne mondiale, Google détient naturellement le canal principal pour promouvoir ses modèles d'IA, pouvant toucher directement une immense base d'utilisateurs.

OpenAI est actuellement valorisée à 500 milliards de dollars, ce qui en fait la startup la mieux valorisée au monde. C'est aussi l'une des entreprises à la croissance la plus rapide de l'histoire, son chiffre d'affaires étant passé de presque zéro en 2022 à une estimation de 13 milliards de dollars cette année. Mais elle prévoit également de brûler plus de 100 milliards de dollars dans les prochaines années pour atteindre l'intelligence artificielle générale, tout en dépensant des centaines de milliards de dollars pour louer des serveurs. En d'autres termes, elle devra encore lever des fonds.

Google a un avantage indéniable : une trésorerie bien plus solide.

Le dernier rapport trimestriel de Google montre que ses revenus ont dépassé pour la première fois les 100 milliards de dollars, atteignant 102,3 milliards de dollars, en hausse de 16 % sur un an, avec un bénéfice de 35 milliards de dollars, en hausse de 33 %. Son flux de trésorerie disponible est de 73 milliards de dollars, et ses investissements en capital autour de l'IA atteindront 90 milliards de dollars cette année.

Pour l'instant, elle n'a pas à s'inquiéter que son activité de recherche soit érodée par l'IA, ses activités de recherche et de publicité affichant toujours une croissance à deux chiffres. Son activité cloud est en plein essor, et même OpenAI loue ses serveurs.

En plus de disposer d'un flux de trésorerie autonome, Google détient également des atouts inaccessibles à OpenAI, comme une immense quantité de données prêtes à l'emploi pour entraîner et optimiser les modèles, ainsi qu'une infrastructure de calcul développée en interne.

Le 14 novembre, Google a annoncé un investissement de 40 milliards de dollars pour construire de nouveaux centres de données

OpenAI excelle dans la négociation, ayant signé des accords de calcul d'une valeur de plus de 1,1 billions de dollars avec divers partenaires. Ainsi, alors que Google, avec Gemini, se rapproche rapidement, les investisseurs se demandent encore plus : la croissance promise par OpenAI pourra-t-elle vraiment combler le déficit ?

Fissure

Il y a un mois, la capitalisation boursière de Nvidia a dépassé les 5 000 milliards de dollars, la passion du marché pour l'intelligence artificielle propulsant ce « marchand d'armes de l'IA » vers de nouveaux sommets. Mais les puces TPU utilisées par Google Gemini 3 ont ouvert une fissure dans la forteresse de Nvidia.

The Economist, citant les données de la société de recherche Bernstein, indique que les GPU de Nvidia représentent plus des deux tiers du coût total d'une baie de serveurs IA typique, alors que les puces TPU de Google ne coûtent que 10 à 50 % du prix des puces Nvidia de performance équivalente. Ces économies sont considérables. La banque d'investissement Jefferies estime que Google produira environ 3 millions de ces puces l'année prochaine, soit presque la moitié de la production de Nvidia.

Le mois dernier, la célèbre startup d'IA Anthropic a prévu d'adopter massivement les puces TPU de Google, avec un accord qui atteindrait plusieurs dizaines de milliards de dollars. Selon un rapport du 25 novembre, le géant technologique Meta est également en pourparlers pour utiliser les puces TPU dans ses centres de données d'ici 2027, pour une valeur de plusieurs milliards de dollars.

Le CEO de Google, Sundar Pichai, présente la puce TPU

Les géants de l'internet de la Silicon Valley misent tous sur les puces, soit en les développant eux-mêmes, soit en collaborant avec des fabricants de puces, mais aucune entreprise n'a progressé autant que Google.

L'histoire des TPU remonte à plus de dix ans. À l'époque, Google a commencé à développer une puce accélératrice dédiée à un usage interne pour améliorer l'efficacité de la recherche, des cartes et de la traduction. Depuis 2018, elle vend des TPU à ses clients cloud.

Depuis, les TPU sont également utilisés pour soutenir le développement interne de l'IA chez Google. Lors du développement de modèles comme Gemini, les équipes IA et puces collaborent : les premières fournissent des besoins et des retours concrets, les secondes optimisent les TPU en conséquence, ce qui améliore à son tour l'efficacité de la R&D en IA.

Actuellement, Nvidia détient plus de 90 % du marché des puces IA. Ses GPU étaient à l'origine conçus pour le rendu réaliste des jeux vidéo, utilisant des milliers de cœurs pour traiter des tâches en parallèle, une architecture qui lui a donné une avance considérable dans l'IA.

Les TPU de Google, en revanche, sont des circuits intégrés spécifiques (ASIC), des « spécialistes » conçus pour des tâches de calcul précises, sacrifiant une certaine flexibilité et polyvalence pour une efficacité énergétique supérieure. Les GPU de Nvidia sont des « généralistes », flexibles et hautement programmables, mais plus coûteux.

Cependant, à ce stade, aucune entreprise, y compris Google, n'est capable de remplacer complètement Nvidia. Bien que les puces TPU en soient à leur septième génération, Google reste un grand client de Nvidia. Une raison évidente est que l'activité cloud de Google doit servir des milliers de clients dans le monde, et la puissance de calcul des GPU garantit leur attractivité.

Même les entreprises qui achètent des TPU doivent aussi utiliser Nvidia. Peu après avoir annoncé un partenariat avec les TPU de Google, Anthropic a également annoncé un important accord avec Nvidia.

Le Wall Street Journal affirme : « Les investisseurs, analystes et opérateurs de centres de données estiment que les TPU de Google sont l'une des plus grandes menaces pour la domination de Nvidia sur le marché du calcul IA, mais pour défier Nvidia, Google doit commencer à vendre ces puces plus largement à des clients externes. »

Les puces IA de Google sont devenues l'une des rares alternatives aux puces Nvidia, ce qui a directement fait baisser le cours de l'action Nvidia. Nvidia a publié un post pour calmer la panique du marché causée par les TPU. Elle se dit « heureuse des succès de Google », mais souligne que Nvidia a une génération d'avance sur le secteur, et que son matériel est plus polyvalent que les TPU et autres puces spécialisées.

Nvidia subit également la pression des inquiétudes du marché concernant une bulle, les investisseurs craignant que les énormes investissements en capital ne correspondent pas aux perspectives de rentabilité. Le sentiment d'investissement peut changer à tout moment : on craint à la fois que l'activité de Nvidia soit prise par d'autres, et que les puces IA ne se vendent pas.

Le célèbre « shorteur » américain Michael Burry a déclaré avoir parié plus d'un milliard de dollars à la baisse sur Nvidia et d'autres entreprises technologiques. Il s'est fait connaître en pariant contre le marché immobilier américain en 2008, une histoire adaptée dans le film à succès « The Big Short ». Il affirme que la frénésie actuelle autour de l'IA ressemble à la bulle internet du début des années 2000.

Michael Burry

Nvidia a distribué aux analystes un document de sept pages pour réfuter les critiques de Burry et d'autres. Mais ce document n'a pas apaisé la controverse.

Modèle

Google traverse une période faste, son cours de bourse progressant à contre-courant dans la bulle de l'IA. L'entreprise de Buffett a acheté ses actions au troisième trimestre, Gemini 3 a reçu des retours positifs, et les puces TPU suscitent l'attente des investisseurs — tout cela propulse Google vers de nouveaux sommets.

Au cours du dernier mois, les actions liées à l'IA comme Nvidia et Microsoft ont chuté de plus de 10 %, tandis que Google a progressé d'environ 16 %. Actuellement, avec une capitalisation boursière de 3,86 billions de dollars, elle se classe troisième mondiale, derrière Nvidia et Apple.

Les analystes qualifient le modèle d'intelligence artificielle de Google d'intégration verticale.

En tant que rare acteur « full stack » de la tech, Google détient toute la chaîne de production : il déploie ses propres puces TPU sur Google Cloud, entraîne ses propres grands modèles d'IA, et ces modèles peuvent être intégrés de manière transparente dans ses activités clés comme la recherche et YouTube. L'avantage de ce modèle est évident : il ne dépend pas de Nvidia et possède une souveraineté de calcul efficace et à faible coût.

L'autre modèle est celui, plus courant, de l'alliance lâche. Les géants se partagent les rôles : Nvidia fournit les GPU, OpenAI, Anthropic, etc. développent les modèles d'IA, Microsoft et d'autres géants du cloud achètent les GPU des fabricants de puces pour héberger les modèles de ces laboratoires d'IA. Dans ce réseau, il n'y a pas d'alliés ou d'adversaires absolus : on collabore quand c'est possible, mais on n'hésite pas à s'affronter quand il le faut.

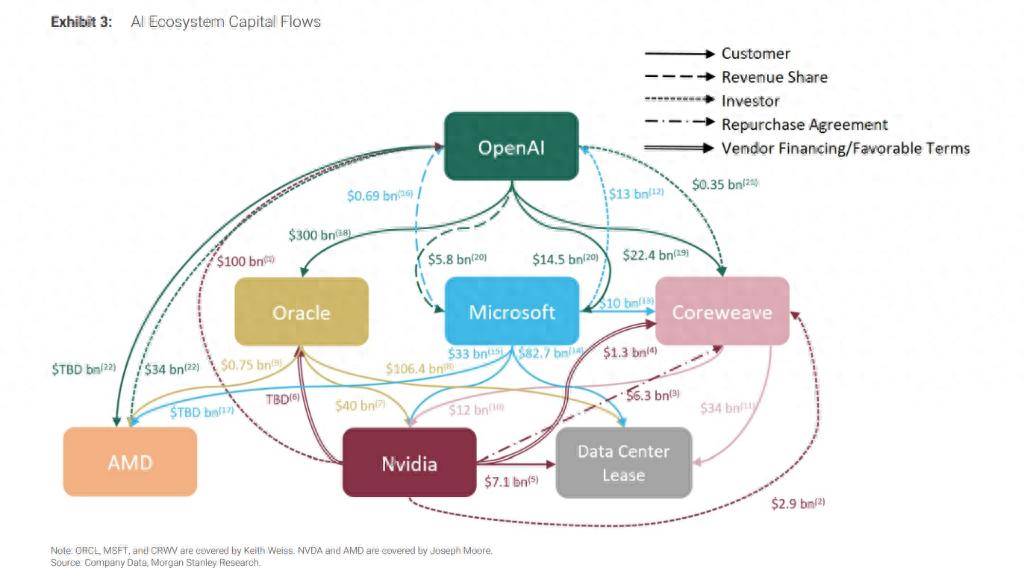

Les acteurs ont formé une sorte de « structure circulaire », les capitaux circulant en boucle fermée entre quelques géants de la tech.

En général, le schéma de financement circulaire est le suivant : l'entreprise A paie d'abord une somme à l'entreprise B (investissement, prêt ou location), puis B utilise cet argent pour acheter les produits ou services d'A. Sans ce « capital de départ », B ne pourrait même pas acheter.

Un exemple : OpenAI dépense 300 milliards de dollars pour acheter de la puissance de calcul à Oracle, Oracle utilise cet argent pour acheter des puces Nvidia et construire des centres de données, puis Nvidia réinvestit jusqu'à 100 milliards de dollars chez OpenAI — à condition qu'ils continuent à utiliser ses puces. (OpenAI paie 300 milliards de dollars à Oracle → Oracle utilise cet argent pour acheter des puces Nvidia → Nvidia réinvestit ses gains chez OpenAI.)

De tels cas ont donné naissance à des schémas de flux de capitaux labyrinthiques. Les analystes de JPMorgan Stanley ont, dans un rapport du 8 octobre, illustré les flux de capitaux de l'écosystème IA de la Silicon Valley avec une photo. Ils avertissent que le manque de transparence rend difficile pour les investisseurs d'évaluer les risques et les rendements réels.

Le Wall Street Journal, commentant cette photo, a déclaré : « Les flèches qui les relient sont aussi complexes qu'une assiette de spaghettis. »

Sous l'impulsion du capital, la silhouette de ce géant attend de prendre forme, sans que personne ne sache à quoi il ressemblera vraiment. Certains sont paniqués, d'autres ravis.