Meta tymczasowo dostosowuje politykę dotyczącą AI chatbotów skierowanych do nastolatków

W piątek czasu lokalnego Meta ogłosiła, że w związku z obawami ustawodawców dotyczącymi bezpieczeństwa oraz niewłaściwych rozmów, firma tymczasowo dostosowuje swoją politykę dotyczącą AI chatbotów skierowanych do młodzieży.

Rzecznik Meta potwierdził, że ten gigant mediów społecznościowych obecnie szkoli swoje AI chatboty tak, aby nie generowały odpowiedzi dla młodzieży na tematy takie jak samookaleczenia, samobójstwa czy zaburzenia odżywiania oraz unikały potencjalnie niewłaściwych emocjonalnych rozmów.

Meta poinformowała, że w odpowiednim czasie AI chatboty będą zamiast tego rekomendować młodzieży zasoby pomocowe oferowane przez profesjonalne instytucje.

W oświadczeniu Meta czytamy: „Wraz z rozwojem naszej bazy użytkowników i postępem technologicznym, stale badamy, w jaki sposób młodzież wchodzi w interakcję z tymi narzędziami i odpowiednio wzmacniamy środki ochrony.”

Ponadto młodzieżowi użytkownicy aplikacji Meta, takich jak Facebook i Instagram, w przyszłości będą mieli dostęp wyłącznie do wybranych AI chatbotów, które są przeznaczone głównie do wsparcia edukacyjnego i rozwoju umiejętności.

Zastrzeżenie: Treść tego artykułu odzwierciedla wyłącznie opinię autora i nie reprezentuje platformy w żadnym charakterze. Niniejszy artykuł nie ma służyć jako punkt odniesienia przy podejmowaniu decyzji inwestycyjnych.

Może Ci się również spodobać

Moment HTTPS dla prywatności Ethereum: od narzędzia obronnego do domyślnej infrastruktury

Podsumowanie „holistycznej rekonstrukcji paradygmatu prywatności” na podstawie dziesiątek prezentacji i dyskusji podczas wydarzenia „Ethereum Privacy Stack” na Devconnect ARG 2025.

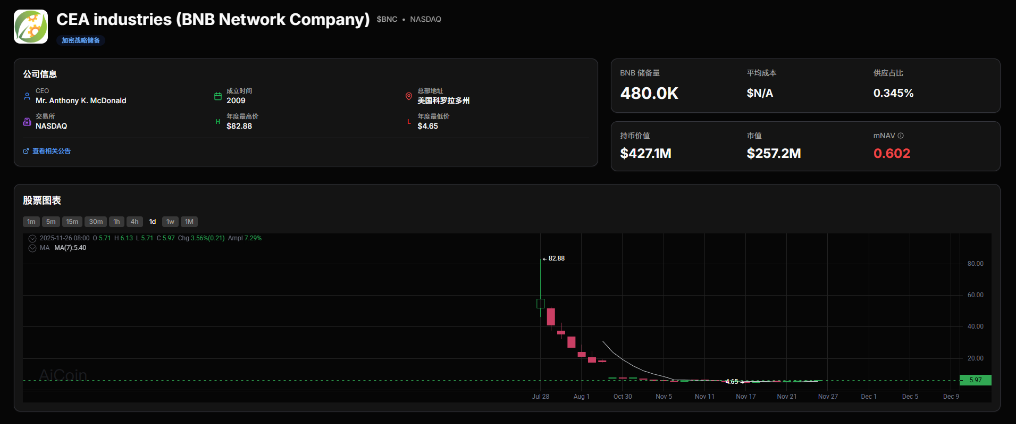

Bunt akcjonariuszy: YZi Labs naciska na zarząd BNC

Halving nie jest już głównym motywem: ETF przepisuje cykl hossy bitcoina

Rynek kryptowalut w warunkach wyczerpania płynności: podwójna próba ETF i dźwigni