Nvidia fordert Tesla heraus, während Jensen Huang dies als den „ChatGPT-Durchbruch“ für autonomes Fahren bezeichnet.

Der Beginn der physischen KI: Nvidias Quantensprung in autonomer Technologie

Nvidia-CEO Jensen Huang erklärte kürzlich, dass das Zeitalter der physischen KI – in der Maschinen die reale Welt wahrnehmen, verstehen und mit ihr interagieren können – offiziell angebrochen sei. Auf der CES in Las Vegas hob Huang die jüngsten Fortschritte des Unternehmens im Bereich autonomes Fahren hervor und markierte damit ein mutiges neues Kapitel für Robotik und KI-gesteuerte Fahrzeuge.

Im Mittelpunkt von Nvidias Ankündigung steht Alpamayo, ein ausgeklügeltes Vision-Language-Action-Modell (VLA), das für selbstfahrende Fahrzeuge und Robotaxis entwickelt wurde. Dieses System ist darauf ausgelegt, Wahrnehmung, Sprachverständnis und Handlungsplanung nahtlos zu verbinden, sodass Fahrzeuge fundierte Entscheidungen im Straßenverkehr treffen können.

Während seiner Keynote präsentierte Huang eine Demonstration, bei der Alpamayo ein Testfahrzeug durch die Straßen von San Francisco steuerte. Das Fahrzeug navigierte mit menschenähnlicher Kompetenz durch komplexe urbane Umgebungen, ohne dass eine manuelle Eingabe erforderlich war.

Mit diesem Durchbruch stellen Branchenbeobachter nun die Frage, ob Nvidias Technologie Teslas aktuelle Fähigkeiten übertreffen und mit der Leistung von Alphabets Waymo mithalten kann, das weithin als führend im Bereich autonomer Ride-Hailing-Dienste gilt.

Nvidias Vision für die Zukunft selbstfahrender Autos

Huang ist äußerst optimistisch in Bezug auf das Potenzial autonomer Fahrzeuge und stellt sich eine Welt vor, in der eine Milliarde selbstfahrender Autos die Straßen teilen. Nvidia entwickelt seine Self-Driving-Technologie seit über einem Jahrzehnt, und Huang hat physische KI-Lösungen wie autonomes Fahren zuvor als Multi-Billionen-Dollar-Marktchance beschrieben.

Auf der CES kündigte Huang an, dass der kommende Mercedes CLA EV als erstes Modell im ersten Quartal des Jahres Nvidias vollständige Self-Driving-Suite, einschließlich Alpamayo, erhalten wird. Bis 2027 will Nvidia autonome Robotaxis in Zusammenarbeit mit Partnern wie Uber und Lucid einsetzen. Derzeit arbeitet Alpamayo auf Autonomiestufe 2, das bedeutet, das Fahrzeug kann eigenständig fahren, benötigt aber weiterhin menschliche Überwachung.

Das ultimative Ziel aller großen Akteure in diesem Bereich ist das Erreichen von Stufe 4 der Autonomie, bei der Fahrzeuge vollständig selbstständig in festgelegten Gebieten fahren können. Während Waymo diesen Meilenstein in ausgewählten Regionen bereits erreicht hat, befinden sich sowohl Teslas als auch Nvidias DRIVE Hyperion System derzeit noch auf Stufe 2. Nvidia arbeitet daran, Alpamayo in naher Zukunft auf Stufe 4 zu bringen.

Katie Driggs-Campbell, Professorin für Ingenieurwissenschaften an der University of Illinois, lobte Nvidias Fortschritte, warnte jedoch davor, dass Öffentlichkeitsarbeit mitunter den tatsächlichen technologischen Errungenschaften voraus sein kann.

Laut Driggs-Campbell stellt Alpamayo einen Schritt über Teslas proprietärem Full Self-Driving (FSD)-System dar, das derzeit noch Fahreraufsicht erfordert. Nvidias Ziel ist es, mit Alpamayo Stufe 4 der Autonomie zu erreichen, während Tesla dies ebenfalls durch kontinuierliche Softwareverbesserungen anstrebt.

Teslas neuronales Netzwerk: Ein datengetriebener Ansatz für Autonomie

Teslas FSD-System setzt auf ein umfassendes neuronales Netzwerk, das mit riesigen Mengen realer Fahrdaten trainiert wurde. Dieser End-to-End-Ansatz verarbeitet Kamera- und Sensordaten direkt zu Steuerbefehlen für das Fahrzeug und verzichtet dabei auf explizite Schlussfolgerungen oder regelbasierte Module.

Trotz seiner Effektivität bleibt Teslas System weitgehend undurchsichtig, da es nur begrenzte öffentliche Informationen über seine Funktionsweise gibt. Nach Nvidias Präsentation zu Alpamayo behauptete Tesla-CEO Elon Musk, dass die neueste FSD-Version von Tesla ähnliche, auf Schlussfolgerungen basierende Techniken einsetze, obwohl eine unabhängige Überprüfung schwierig ist.

Bekannt ist, dass Teslas neuronales Netzwerk aus Millionen von Fahrvideos lernt und so Fahraufgaben erledigen kann, ohne die Gründe für seine Entscheidungen transparent zu machen. Diese „Black-Box“-Eigenschaft bedeutet, dass Ingenieure nur das Ergebnis bewerten können, nicht jedoch die zugrunde liegende Logik.

Driggs-Campbell bemerkte, dass Teslas Ansatz auf klassischem Deep Learning basiert, bei dem Eingabebilder und Sensordaten anhand zahlloser Trainingsbeispiele Fahraktionen zugeordnet werden. Ein Vorteil für Tesla ist die Datensammlung durch die große Flotte – fast 9 Millionen produzierte Fahrzeuge – von denen die meisten visuelle Daten zur stetigen Verbesserung des Modells beitragen.

Der größte Nachteil ist die mangelnde Interpretierbarkeit: Es ist schwierig, den Entscheidungsprozess des Systems nachzuvollziehen oder gezielt zu optimieren, außer die Resultate zu beobachten.

Reasoning-Modelle: Das Paradigma „Schnelles und langsames Denken“

Im Gegensatz zu Teslas reaktivem neuronalen Netzwerk integrieren Nvidias Alpamayo und Waymos Systeme explizite Schlussfolgerungen in ihre Entscheidungsfindung.

Trifft beispielsweise ein mit Alpamayo ausgestattetes Fahrzeug auf eine defekte Ampel, kann es die Situation analysieren, das Szenario mittels sprachbasierter Schlussfolgerung interpretieren (etwa anhalten, auf Hindernisse prüfen und sicher weiterfahren) und dann die passende Handlung ausführen.

Waymo setzt auf eine „Zwei-Systeme“-Methodik, die oft als „schnelles und langsames Denken“ beschrieben wird. Das erste System reagiert instinktiv auf Sensoreingaben, während das zweite System komplexe Aufgaben überlegt und durchdenkt. Beide Systeme münden in einen „World Decoder“, der die optimale Handlung bestimmt. Wichtig ist, dass explizite Regeln das System bei Bedarf übersteuern können.

Driggs-Campbell erklärte, dass die meisten autonomen Systeme Schutzmechanismen enthalten – fest programmierte Regeln für Situationen, die keine Schlussfolgerung erfordern, wie das Verbleiben auf der Straße. Die Integration mehrerer Systeme kann jedoch manchmal zu unerwartetem Verhalten oder Konflikten führen.

Ein Beispiel aus der Praxis ereignete sich in San Francisco, als Waymos Robotaxis während eines Stromausfalls, der die Ampeln lahmlegte, Schwierigkeiten hatten, Kreuzungen zu durchfahren – was die Herausforderungen von regel- und schlussfolgerungsbasierten Modellen aufzeigt.

Elon Musk merkte an, dass Teslas FSD-gestützte Robotaxis, die derzeit in San Francisco getestet werden, von dem Ausfall nicht betroffen waren. Da Teslas System jedoch keine Schlussfolgerungen ausgibt, ist es für Ingenieure schwierig zu verstehen oder zu verbessern, wie die Fahrzeuge die Situation gemeistert haben.

Vergleich der Ansätze: Datengetrieben gegen schlussfolgerungsbasiert

Während Reasoning-Modelle wie Alpamayo und Waymos Zwei-System-Architektur mehr Transparenz und potenziell sichereres Verhalten in komplexen Szenarien bieten, stehen sie auch vor Herausforderungen hinsichtlich Geschwindigkeit und Echtzeit-Performance. Im Gegensatz dazu können Teslas datengetriebene neuronale Netze schnell und effizient reagieren, fehlen aber an Interpretierbarkeit.

Driggs-Campbell räumte ein, dass Teslas neuronale Netze Vorteile bei Geschwindigkeit und Recheneffizienz bieten, es jedoch schwierig ist, abschließend zu beurteilen, welcher Ansatz überlegen ist. Sie beobachtete, dass Foundation-Modelle, wie sie bei Waymo und Nvidia zum Einsatz kommen, vielversprechende Ergebnisse liefern, aber weiterhin große Hürden bestehen.

Sie wies darauf hin, dass die Übertragung der Fähigkeiten großer Reasoning-Modelle auf das Echtzeitfahren eine enorme Herausforderung bleibt, da Schlussfolgerungen oft einige Sekunden benötigen – viel langsamer als die im Straßenverkehr erforderlichen Reaktionen in Sekundenbruchteilen.

Zusammenfassend setzt Teslas FSD derzeit den Maßstab für fortschrittliche Fahrerassistenzsysteme, gestützt auf riesige Datensätze und breite Verbreitung. Es bleibt jedoch ein reaktives, überwachtes System. Alpamayo und ähnliche schlussfolgerungsbasierte Modelle repräsentieren die nächste Generation, die auf mehr Sicherheit, Vorhersehbarkeit und Transparenz abzielt, aber noch weiter verfeinert und beschleunigt werden muss.

Letztlich verfolgen sowohl Teslas FSD als auch Reasoning-Modelle wie Alpamayo dasselbe Ziel: vollautonomes Fahren – eine Herausforderung, die manche mit der Mondlandung vergleichen.

Wie Elon Musk anmerkte, ist die Bewältigung der seltenen und komplexen „Long-Tail“-Szenarien des realen Fahrens äußerst anspruchsvoll, doch er sprach Nvidia seine Unterstützung aus, auch wenn er weiterhin von Teslas Ansatz überzeugt ist.

Bleiben Sie informiert

Entdecken Sie die neuesten Technologiemeldungen mit Einfluss auf die Märkte

Lesen Sie aktuelle Finanz- und Wirtschaftsnachrichten auf Yahoo Finance

Haftungsausschluss: Der Inhalt dieses Artikels gibt ausschließlich die Meinung des Autors wieder und repräsentiert nicht die Plattform in irgendeiner Form. Dieser Artikel ist nicht dazu gedacht, als Referenz für Investitionsentscheidungen zu dienen.

Das könnte Ihnen auch gefallen

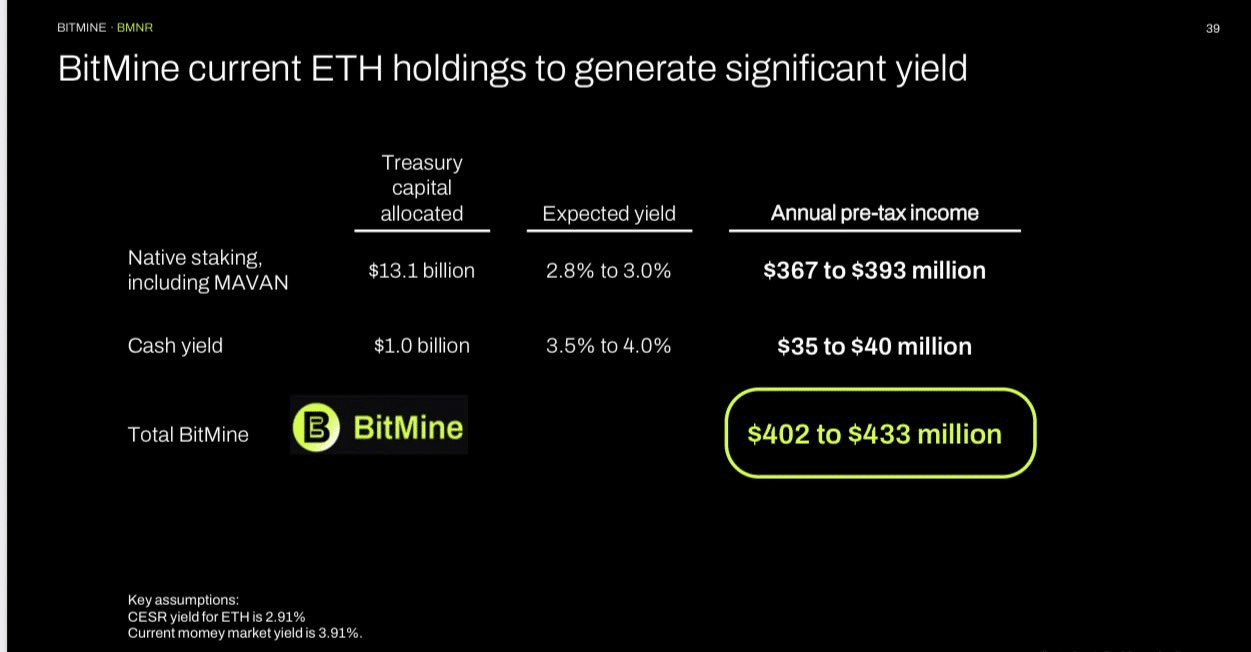

Von $3.5K auf $12K? Darum ist die Ethereum-Prognose von BMNR sinnvoll

Jüngste finanzielle Maßnahmen von Trump lösen erneut Bedenken hinsichtlich möglicher Interessenkonflikte aus

XRP Kursprognose Januar 2026: Onchain-Signale erhöhen die Chancen für eine XRP-Rallye