ジェミニはどこにでもある:Google I/O 15の2025の重要なAI発表

簡単に言えば AIに全面的に焦点を絞ったGoogle I/O 2025では、Gemini、Imagen 4、検索におけるAIモード、スマートグラス、リアルタイムのMeet翻訳、クリエイティブツールなどの主要な発表が行われ、GoogleのAIファースト戦略が強調されました。

2025月20日に開催されたGoogle I/O XNUMXは、人工知能(AI)に全面的に焦点を絞ったものでした。GoogleはXNUMX時間の基調講演で、新しいガジェットやハードウェアではなく、自社のAIシステム、特にGeminiがほぼすべての製品に搭載されている様子を示しました。これらのツールはもはや背景に隠れているのではなく、人々がオンラインで検索、閲覧、創作、そしてコミュニケーションを行う上で、目に見える形で積極的に活用されるようになっています。

ここでは、Google がアプリ、デバイス、サービス全体で AI を日常的なツールに変えている様子を示す、最も重要な 15 のアップデートのリストを紹介します。

AIが核となる:検索、Chrome、そしてよりスマートなアシスタント

Googleは基調講演の冒頭、AIが現在Googleの最もよく使われるツールの中核でどのように機能しているかを示しました。これらのアップデートは、検索、ブラウジング、そして自律的に動作するよりスマートなアシスタントに重点を置いています。

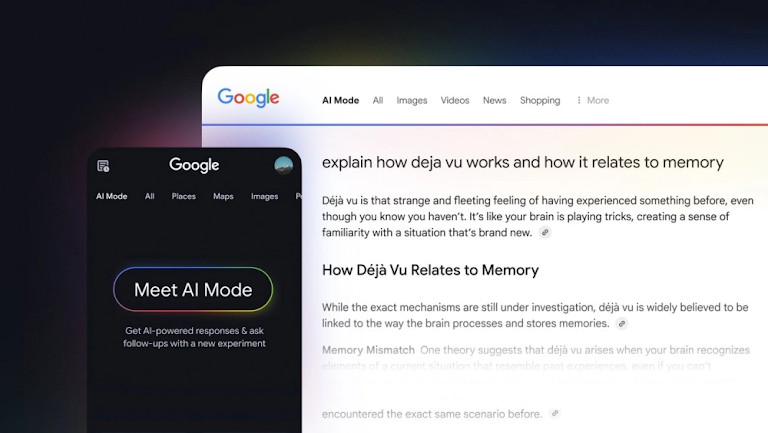

米国でAI検索モードが利用可能に

A AIモードという新しいタブ Google検索に「検索」機能が追加されました。短い単語をバーに入力する代わりに、Gemini を利用したチャットウィンドウを使って検索できます。この新しいモードにより、ユーザーはより長い質問をして、完全な文章で回答を得ることができます。

Googleによると、ユーザーが検索クエリを書く量は以前より2~3倍長くなっているとのことです。AIモードは現在、米国でのみ利用可能ですが、今後より広範囲に展開する予定です。

有料ユーザー向け Chrome の Gemini

21月XNUMX日より、AI ProまたはAI Ultraのサブスクリプションをご利用のお客様は、ChromeにGeminiが組み込まれます。このアシスタントは、タブ内でウェブページを読み上げて説明したり、商品を比較したり、ブラウジングの手順を案内したりできます。現在は一度にXNUMXつのタブでのみ動作しますが、Googleはこの数を増やす予定です。

プロジェクト・アストラにビジュアルインテリジェンスが加わる

Googleの実験的なアシスタント「Project Astra」は、スマートフォンのカメラを通して見たものを理解するようになりました。指示しなくても、視覚情報に反応できます。例えば、数学の課題の間違いに気づいたり、ユーザーの周囲にあるものを特定したりするかもしれません。観察し、考え、そして有益な情報がある場合にのみ発言します。

検索ライブとジェミニライブにビジュアル入力を追加

新しいSearch Live機能では、カメラに何かを見せながらアシスタントに話しかけ続けることができます。アシスタントは会話に参加し続け、見たものを理解し、役立つ回答を提供します。また、Gemini Liveでは、AndroidとiOSの両方で、サブスクリプションなしで誰でも画面を共有できるようになりました。

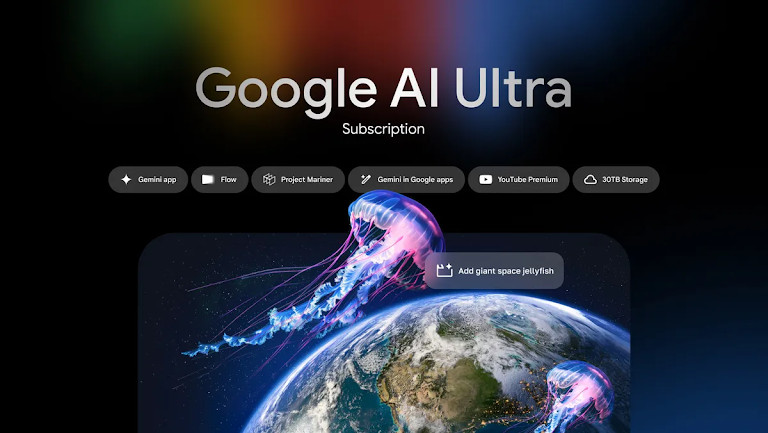

AI Ultraサブスクリプションが月額250ドルで導入されました

GoogleはAI Ultraと呼ばれる最上位プランを発表した。 月額250ドルで、ユーザーは他社よりも先に高度なAI機能にアクセスできます。これには、ChromeでのGeminiの早期利用、Project Mariner(ブラウザタスクを自動化する将来のエージェント)、複雑なAIジョブに対する制限の拡大などが含まれます。

AIで作る:動画、画像、インターフェースデザイン

次に、Google は Gemini、Imagen 4、Veo 3 を搭載したクリエイティブ ツールを導入しました。これにより、ユーザーは言葉やスケッチだけでコンテンツを生成し、アプリをデザインできるようになりました。

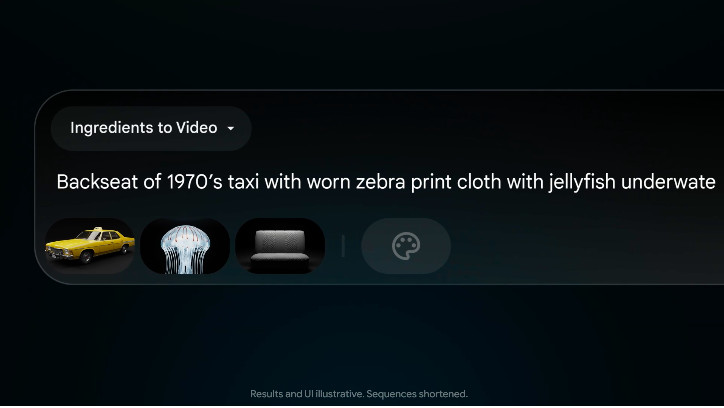

Flow: 短編AI動画のための新アプリ

Flowは、ユーザーが8秒間のビデオクリップを作成できるツールです。 短いテキスト説明や画像を使って、動画を制作できます。Veo 3、Imagen 4、Geminiの機能を統合しています。アプリ内では、簡単な音声またはテキストコマンドを使って、クリップのスタイルを変更したり、エフェクトを追加したり、クリップをリンクさせて長編動画を作成したりできます。Googleは、Flowが将来、長編映画にも利用されることを期待しています。

Imagen 4とVeo 3がリリースされました

Imagen 4は言葉からより良い画像を作成します さまざまな種類の画像に対応し、より明確なテキストから画像への生成が可能になります。

Veo 3は音声付き動画を作成でき、仮想カメラの操作やオブジェクトの削除も可能です。Veo 2もアップデートされ、編集ツールがさらに充実しました。

Stitch: スケッチからユーザーインターフェースを設計するAI

Stitchは、シンプルな絵や説明文からアプリのインターフェースを構築できるデザインツールです。ラフスケッチをアップロードしたり、必要なものを説明したりすると、システムがレイアウトを構築します。StitchはスクリーンショットとUIプレビューをサポートしています。まだテスト段階ですが、近い将来、FigmaやAdobeのツールに匹敵する存在になるかもしれません。

会議、メール、会話におけるAI

AIは、言語、画面、アプリをまたいだコミュニケーションをよりスムーズにします。GmailからMeetまで、Googleはリアルタイムヘルプとパーソナライズされたレスポンスを提供しています。

Google Meet のリアルタイム音声翻訳

Google Meetがリアルタイム翻訳に対応 英語からスペイン語への音声会話から開始します。AI ProおよびUltraユーザー向けにベータ版としてご利用いただけます。音声翻訳は遅延がほとんどないため、言語間の会議がスムーズになります。今後、他の言語にも対応予定です。

Gmailのスマート返信がよりパーソナルに

Gmailのスマート返信機能は、受信トレイの内容とGoogleドライブのファイルを利用するようになりました。これにより、よりパーソナライズされ、状況に応じた返信を作成できます。このツールは、返信がフォーマルかカジュアルかを判断し、必要に応じてスプレッドシートやマップのリンクなどのファイルも取得します。展開は2025年XNUMX月に開始されます。

XRとウェアラブル:メガネと拡張現実

ハードウェア関連のアップデートは数少ないものの1つで、スマートグラスとAndroid XRプラットフォームに関するものでした。Googleは、Geminiが現実世界の環境でどのように動作するかを示しました。

Project Aura: Android XR 搭載スマートグラス

プロジェクトオーラはスマートグラスです Xrealと共同開発したAndroid XRプラットフォームを採用したメガネです。サングラスのような外観で、カメラとマイクを搭載しています。リアルタイム翻訳、ナビゲーション、そしてGeminiを搭載したその他の機能をサポートします。

Auraはまだプロトタイプですが、Googleが複合現実を日常生活に取り入れる計画を示しています。Samsung、Warby Parker、Gentle Monsterといった企業もGoogleと共同で独自のバージョンの開発に取り組んでいます。

Android XRプラットフォームの拡張

Project Moohanで先行導入されたAndroid XRシステムは、より多くのスマートウェアラブルデバイスに対応し、インタラクションにはGeminiを採用しています。より豊富なARコンテンツと優れた音声入力をサポートすることで、AppleのVision Proと直接競合することになります。

AI + コマース:ショッピングとオンラインの安全性

Googleはまた、AIがショッピングやアカウントの安全性にどのように役立つかをテストしています。バーチャルで服を試着したり、パスワードを修正したりと、これらのツールはデジタルタスクの簡素化を目指しています。

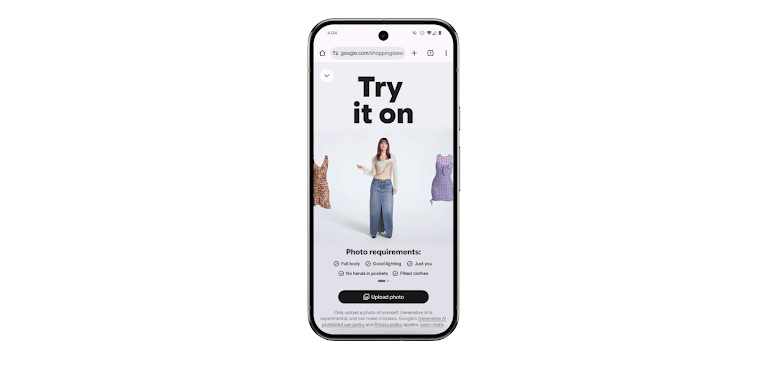

AIを活用したバーチャルショッピングと試着

Googleがバーチャル試着室をテスト中 ユーザーの体型写真を使って、服の見え方を予測する機能です。まだテスト段階です。AIモードにも同じツールが追加され、アシスタントが商品の検索や価格の追跡を手伝い、さらには価格が下がった際に自動的に購入してくれるようになります。

Chromeは弱いパスワードを自動置換します

今後のアップデートでは、Chromeは安全でないパスワードをより強力なパスワードに自動的に置き換えることができるようになります。ユーザーが同意すると、Chromeはサイトにログインし、自動的にパスワードを変更します。これは、変更を提案するだけのGoogleパスワードマネージャーの現在のアラートシステムを超える機能です。

プラットフォームの改善と静かな追加

最後に、GoogleはAndroid、Wear OS、開発者ツールに関する小規模ながらも重要なアップデートを発表しました。これらの多くはGemini 2.5 Flash上で実行され、アプリのバックグラウンド動作を改善します。

- Android 16 ベータ版 4.1 がリリースされました。正式リリースはXNUMX月を予定しています。

- Wear OS 6 では、Material 3 Expressive によりビジュアル スタイルが追加され、外観をより簡単にカスタマイズできるようになります。

- NotebookLM はモバイル アプリとして利用できるようになりました。Gemini 2.5 Flash 上で実行され、ドキュメントの読み取りと応答性が向上します。

- ブラウザタスクを実行する新しい AI システムである Project Mariner が、まもなく Gemini API の一部になります。

ジェミニが単なる名前ではなくなった理由

Google I/O 2025は、同社の人工知能へのアプローチに大きな転換を示し、ユーザーの日常生活にシームレスに統合される実用的なアプリケーションを強調しました。CEOのサンダー・ピチャイは、検索におけるAIモードの導入について説明しました。 「検索の完全な再考」として より複雑なクエリを処理し、会話型の AI 主導の応答を提供する可能性を強調しています。

Google DeepMindのCEOであるデミス・ハサビス氏は、ジェミニ2.0の進歩について次のように述べた。 目標は「パーソナルで、プロアクティブで、パワフルな」AIを開発することだ。 さまざまなデバイス上でコンテキストを理解し、ユーザーに代わってアクションを実行できます。

これらの開発は、従来の検索および生産性ツールから、より統合されたAIファーストのエコシステムへの移行を目指すGoogleのコミットメントを強調するものであり、defiプラットフォーム全体でユーザーとのインタラクションを構築します。

免責事項:本記事の内容はあくまでも筆者の意見を反映したものであり、いかなる立場においても当プラットフォームを代表するものではありません。また、本記事は投資判断の参考となることを目的としたものではありません。

こちらもいかがですか?

BitgetよりELX/USDTのマージン取引サービス停止に関するお知らせ

新規グリッドトレーダー向け特典&合計150 USDTのダブル報酬を受け取るチャンス!

BitgetよりBEAM/USDT, ZEREBRO/USDT, AVAIL/USDT, HIPPO/USDT, ORBS/USDTのマージン取引サービス停止に関するお知らせ

【MoneyCharger様】アメリカ株ETFとは?QQQの仕組みと魅力をわかりやすく解説【Bitgetでの取引方法も紹介】