LatePost ekskluzywne | IPO Zhipu, wewnętrzny list Tanga Jie wymaga pełnego powrotu do badań nad podstawowymi modelami

Ostatecznie o układzie sił w kolejnej fazie zdecydują dwie podstawowe kwestie – architektura modelu oraz paradygmaty uczenia. Jednocześnie po stronie zastosowań może pojawić się wyraźny kierunek: rok eksplozji AI zastępującej różne zawody/zadania.

Autor丨Shen Yuan

Redakcja丨Song Wei

Późny Wieczór uzyskał wyłączną informację, że w dniu debiutu giełdowego Zhipu 8 stycznia, profesor Wydziału Informatyki Uniwersytetu Tsinghua, założyciel i główny naukowiec Zhipu, Tang Jie, opublikował wewnętrzny list, ogłaszając rychłe wprowadzenie nowej generacji modelu GLM-5.

Tang Jie powiedział, że dzisiaj jest „ekscytującym dniem w życiu Zhipu”. Nie odniósł się bezpośrednio do kontrowersji wokół modelu biznesowego firm zajmujących się dużymi modelami ani nie przedstawił celu komercjalizacji Zhipu na 2026 rok, ale podkreślił, że prawdziwym osiągnięciem Zhipu na drodze do AGI są teorie, technologie lub produkty, które są „rzeczywiście używane” i mogą pomóc większej liczbie ludzi.

DeepSeek wywołał wstrząs wśród chińskich przedsiębiorstw tworzących duże modele, a wielu uważa, że spektakularny sukces DeepSeek przede wszystkim uderzył w ekosystem Zhipu — oba zespoły mają niemal identyczne zaplecze badawczo-naukowe, a Zhipu wniósł równie duży wkład w open source dużych modeli.

Wewnętrzny list wskazuje, że Zhipu w 2025 roku zrealizował zgodnie z planem strategię wyznaczoną na początku roku: w kwietniu wypuścił model „stabilizujący pozycję”, w połowie roku model „siadający do stołu” (stający się jednym z najlepszych), a na koniec roku model Top 1.

Ta strategia pełnego powrotu do badań nad podstawowymi modelami jest odpowiedzią Zhipu na wyzwanie DeepSeek. 23 grudnia podstawowy model Zhipu GLM-4.7 został udostępniony i otwarty, a wskaźnik Artificial Analysis (AA) pokazuje, że GLM-4.7 zajmuje pierwsze miejsce wśród modeli chińskich i ex aequo z Claude 4.5 Sonnet szóste miejsce na świecie.

Oprócz wydania GLM-5, wewnętrzny list przedstawia także trzy kierunki technologiczne, na których Zhipu skupi się w 2026 roku, w tym zupełnie nowy projekt architektury modelu, bardziej uniwersalny paradygmat RL (uczenie ze wzmocnieniem) oraz eksplorację ciągłego uczenia się i autonomicznej ewolucji modeli. Wszystkie koncentrują się na poprawie podstawowych możliwości modeli.

W 2025 roku Zhipu przeszedł także znaczną restrukturyzację organizacyjną, ograniczając skalę zespołów To C, R&D i generowania wideo, a wyniki, w tym AutoGLM, zostały stopniowo otwarte.

Od czasu wydania ChatGPT, przez ponad trzy lata szybkiego rozwoju AI, „branża nie osiągnęła żadnego konsensusu, wszyscy po prostu idą do przodu.” Tang Jie powiedział podczas jednego ze spotkań wewnętrznych.

Poniżej pełny tekst listu otwartego Tanga Jie, ekskluzywnie opublikowany za zgodą Zhipu przez Późny Wieczór.

Tworzyć AGI z duchem „kawy”

Podczas krótkiej wizyty na Hong Kong University of Science and Technology przypadkowo spotkałem profesora Yang Qiang w kawiarni na parterze laboratorium. Powiedziałem, że ostatnio piję za dużo kawy, zaczynam mieć nałóg i muszę przestać.

Profesor Yang powiedział: „Dlaczego musisz przestać? Uzależnienie niekoniecznie jest złe, jeśli nasze badania mogą być tak uzależniające jak kawa, to czemu mielibyśmy się obawiać, że nie będą dobre?”.

To prawda, „uzależnienie” jest właśnie tym, co czyni życie fascynującym, niezależnie czy to badania, czy inne rzeczy — jeśli jesteś skoncentrowany i pracowity, z pewnością osiągniesz sukces.

„Sprawić, by maszyny myślały jak ludzie” to od początku wizja i ideał Zhipu oraz jedyny cel, do którego dąży zespół Zhipu.

Pod koniec 2018 roku, zainspirowani teorią dwóch systemów poznawczych mózgu, zaprojektowaliśmy maszynowy system „poznawczy” z szybkim i wolnym myśleniem. W 2019 roku oficjalnie założyliśmy Zhipu i rozpoczęliśmy eksplorację AGI, aby urzeczywistnić ambitną wizję „sprawienia, by maszyny myślały jak ludzie”.

Największym wyzwaniem było to, że do dziś nikt, w tym my sami, nie potrafi dokładnie zdefiniować AGI ani podać technicznej drogi do jego realizacji — i może właśnie w tym tkwi urok eksploracji AGI.

Znajdujemy się w wyjątkowym momencie historii, w czasie, gdy technologia po raz kolejny rewolucyjnie zmienia świat. Duże modele to nie tylko kluczowa podstawa ogólnej sztucznej inteligencji, ale mają też szansę stać się silnikiem napędzającym przemiany w produktywności.

Patrząc wstecz, jednym z głównych powodów, dla których doszliśmy do obecnego momentu, jest to, że zawsze skupialiśmy się na tworzeniu AI, która jest naprawdę użyteczna dla użytkowników. Tylko teorie, technologie i produkty faktycznie używane przez ludzi mogą stać się znaczącymi osiągnięciami na drodze do AGI. Oczywiście nie każda innowacja kończy się sukcesem, mieliśmy wiele projektów ryzykownych, które się nie powiodły, ale to właśnie one nauczyły nas czerpać siłę z porażek. To uczyniło Zhipu silniejszym i pogłębiło nasze zrozumienie AGI. Co ważniejsze, pozwoliło nam nie skupiać się wyłącznie na krótkoterminowych korzyściach: pomaganie użytkownikom, krajowi i globalnemu postępowi technologicznemu stało się długoterminowym celem Zhipu.

W 2020 roku wprowadziliśmy własną architekturę algorytmiczną dużych modeli GLM i zaczęliśmy trenować podstawowy model o 10 miliardach parametrów. Model odniósł sukces i został poddany testom przez wiele firm, w tym Meituan. Było to bardzo odważne posunięcie, bo wtedy dominowały jeszcze małe modele BERT. Jednak sukces ten był daleki od naszego marzenia o AGI. Częściowo dlatego, że model nie miał wystarczającej wiedzy, a częściowo dlatego, że nie potrafił jeszcze rozumować jak człowiek.

W latach 2021–2022 rozwój dużych modeli nie przebiegał gładko. Większość ludzi nie akceptowała „sprawienia, by maszyny myślały jak ludzie”, uznając to za szalony plan w stylu lądowania na Księżycu, nie widząc w tym wielkiej szansy technologicznej, albo obawiając się porażki. My jednak postanowiliśmy zaryzykować i wytrenować duży model o 130 miliardach parametrów na większej ilości danych.

Decyzja ta była trudna, ponieważ nie mogła wpłynąć na ogólne tempo rozwoju firmy. W tym celu założyliśmy dwa małe, innowacyjne zespoły: jeden odpowiedzialny za trening modelu, tzw. trójka muszkieterów GLM, drugi – niezależny – za budowę platformy MaaS. Wówczas te dwa zespoły prawdopodobnie nie wiedziały o swoim istnieniu. W połowie 2022 roku udało się wytrenować GLM-130B, którego wiele szczegółowych rozwiązań przyciągnęło uwagę na całym świecie. Równocześnie uruchomiliśmy platformę MaaS, czyli obecne bigmodel.cn, zdobywając pierwszych prawdziwych użytkowników API. Następnie powołaliśmy w firmie Instytut AI, skupiający się na badaniach nad nową generacją dużych modeli, oraz dział platformy MaaS, świadczący usługi API. Czasem trzeba znaleźć ludzi z odważnymi marzeniami (a nawet poświęcić czas, by ich znaleźć) – śmiałe cele to połowa sukcesu.

W 2023 roku rozmawiałem z jednym z czołowych przedsiębiorców startupowych w kraju (choć jest ode mnie sporo młodszy) o tym, jak AI może zmienić przyszłość. Zgodziliśmy się, że AI zrewolucjonizuje wyszukiwanie, przeglądarki i przyniesie każdemu nowego asystenta AI. Gdy już go będziemy mieć, nie będziemy potrzebować sklepów z aplikacjami – przeciwnie, będziemy musieli stworzyć dla AI „sklep z API”. Logika tego sklepu może zrewolucjonizować obecne systemy operacyjne, a w dalszej kolejności być może nawet sam komputer, bo nie będziemy już potrzebować komputera dla ludzi, tylko takiego, który będzie odpowiedni dla AI.

Znaczenie tej rewolucji będzie ogromne, ponieważ całkowicie zmieni logikę komputerów, kwestionując fundament 80-letniej informatyki – architekturę von Neumanna. Gdy o tym rozmawialiśmy, oboje stwierdziliśmy, że nasze zaangażowanie w AI jest wciąż zbyt małe, jeszcze nie jesteśmy „all-in”.

Rzeczywistość bywa brutalna – „all-in” wymaga nie tylko silnej wiary, ale także potężnego wsparcia finansowego i zespołowego oraz precyzyjnych prognoz. Lata 2023–2024 to czas eksplozji dużych modeli na całym świecie, wielkie firmy „all-in” w duże modele, a w Chinach rozkwit przedsiębiorczości, setki modeli i niezliczeni asystenci AI.

Wtedy też popełniliśmy pewne błędy — zarówno techniczne, jak i biznesowe. Teraz, patrząc wstecz, powodem mogło być to, że chwilami gubiliśmy się na drodze do AGI, dając się zwieść krótkoterminowym zyskom i chwilowemu zgiełkowi. AGI to rewolucja technologiczna, technologia powinna być sprawiedliwa, otwarta, transparentna i dostępna dla wszystkich, by każdy mógł z niej skorzystać.

Pojawienie się DeepSeek otworzyło nam oczy. W 2023 roku, gdy Wenfeng startował z własnym biznesem, rozmawiał ze mną, ale nie zdawałem sobie sprawy, jak bardzo jest oddany AGI. Dziękuję mu za nowe spojrzenie. Nieustanne dążenie do AGI, eksploracja jej granic i precyzyjne przewidywanie przyszłości to kolejne obszary, które musimy w Zhipu stale udoskonalać i rozwijać. Te dwa lata bardzo nas wzmocniły, a przede wszystkim „wzmocniły” nasze rozumienie AGI, zarządzania firmą i konkurencji biznesowej.

W minionym roku przeprowadziliśmy dość systematyczne „wzmocnienie”. Ogłosiliśmy hasła „samokontrola” i „osiągnięcia”, wymagając od wszystkich, by zachowali spokój, nie byli ani aroganccy, ani nieśmiali, skupili się na własnych zadaniach i osiągali sukcesy indywidualne oraz dla Zhipu.

Początek roku był bardzo trudny, modele nie spełniały oczekiwań, w całych Chinach trwała wojna cenowa — przebicie się wymagało precyzyjnego punktu przełamania.

Wytrwaliśmy i znaleźliśmy przełom w Coding.

Jeśli kwietniowe wydanie GLM-4.1 było symbolicznym rozpoznaniem, to wydanie GLM-4.5 pod koniec lipca było niemal decydującą bitwą. Wszystkie zespoły techniczne, platformowe, biznesowe pracowały pod ogromną presją i po nieprzespanych nocach w końcu odnieśliśmy długo wyczekiwane zwycięstwo. Potem GLM-4.6 i GLM-4.7 pozwoliły nam dorównać czołowym światowym modelom. Nasz GLM-4.7 uzyskał SOTA wśród modeli open source i chińskich w wielu rankingach (AA, Arena), a doświadczenia użytkowników w Coding i agencie były bardzo pozytywne. 150 tys. deweloperów z 184 krajów korzysta z GLM Coding Plan, a po wydaniu GLM-4.7 roczny ARR platformy MaaS przekroczył 500 mln (w tym ponad 200 mln z zagranicy), a wzrost z 20 mln do 500 mln (25 razy) nastąpił w zaledwie 10 miesięcy.

Ogólnie rzecz biorąc, po stronie modeli zrealizowaliśmy zgodnie z planem strategię: w kwietniu model „stabilizujący pozycję”, w połowie roku model „siadający do stołu” (czyli jeden z najlepszych), a na koniec roku model Top 1. To położyło solidne fundamenty pod dalszą walkę o szczyty technologii AGI.

Nasze „suwerenne AI” również poczyniło postępy: malezyjska narodowa platforma MaaS została zbudowana na otwartym modelu Z.ai, a GLM stał się narodowym modelem Malezji. Wyjście suwerennego AI za granicę było dla mnie inspiracją po spotkaniu z Sekretarzem Generalnym i jego wezwaniu, by „chińskie AI wyszło w świat”, ale szczerze mówiąc, nie wiedziałem, jak to zrobić. Nasz zespół międzynarodowy odważył się podjąć wyzwanie i osiągnął przełom od zera do eksportu chińskiego dużego modelu za granicę. Biznesowo znów osiągnęliśmy ponad dwukrotny wzrost przychodów w ciągu roku.

W obliczu wielu trudności i szans, dziś w niemal niemożliwy sposób staliśmy się pierwszym na świecie publicznym dużym modelem — co pokazuje uznanie rynku dla naszej technologii i wartości biznesowej. „Make impossible possible” — pamiętasz, jak to mówiliśmy?

W tym roku największą przemianę przeszli chyba nie Zhipu, ale młodzi ludzie z pierwszej linii, którzy naprawdę dokonali niemożliwego.

W 2026 roku celem firmy jest stanie się wiodącym na świecie przedsiębiorstwem dużych modeli. W minionym roku wiele dyskusji o dużych modelach koncentrowało się na aplikacjach i ekosystemie.

Ostatecznie o układzie sił w kolejnej fazie zdecydują dwie podstawowe kwestie — architektura modelu oraz paradygmaty uczenia. Jednocześnie po stronie zastosowań może pojawić się wyraźny kierunek: rok eksplozji AI zastępującej różne zawody/zadania.

Opierając się na tym założeniu, w 2026 roku skupimy się na:

GLM-5. Wkrótce GLM-5 zostanie udostępniony wszystkim — dzięki dalszemu skalowaniu i wielu nowym technologiom, GLM-5 przyniesie wiele nowości i pozwoli AI pomóc w realizacji większej liczby rzeczywistych zadań.

Nowa architektura modelu. Stosowany od prawie 10 lat Transformer ujawnia już swoje ograniczenia: koszt obliczeń dla bardzo długiego kontekstu, mechanizmy pamięci, mechanizmy aktualizacji itd. Wymaga to eksploracji zupełnie nowych architektur modeli, odkrywania nowych paradygmatów skalowania i zwiększania wydajności obliczeń poprzez współprojektowanie chipów i algorytmów.

RL o większej zdolności uogólniania. Obecny dominujący paradygmat RLVR osiągnął sukces w matematyce i kodowaniu, ale coraz wyraźniej widać jego ograniczenia związane z ręcznie tworzonym, weryfikowalnym środowiskiem. W tym roku trzeba eksplorować bardziej uniwersalne paradygmaty RL, by AI mogło nie tylko wykonywać konkretne zadania na polecenie człowieka, ale także rozumieć i realizować zadania trwające wiele godzin, a nawet dni.

Największym wyzwaniem będzie rozpoczęcie drogi do ciągłego uczenia się i autonomicznej ewolucji. Obecnie wszystkie główne modele AI są statyczne po wdrożeniu — wiedzę zdobywają jednorazowo w bardzo kosztownym procesie treningu, a potem się starzeją. To zupełnie inaczej niż mózg człowieka, który stale uczy się i ewoluuje w interakcji ze światem. Musimy już teraz planować kolejny paradygmat uczenia — online learning lub continual learning.

Nie jesteśmy tradycyjną firmą i nie zamierzamy nią być. Chcemy być AI-native — firmą, w której wszystko jest możliwe: budować modele przesuwające granice inteligencji, tworzyć produkty i usługi skoncentrowane na AI dla użytkowników. Chcemy, aby AI stała się najlepszym asystentem każdego człowieka, pomagającym realizować zadania. Uważamy, że należy także wykorzystać AI do optymalizacji zarządzania firmą i zwiększania efektywności oraz sprawiedliwości.

Z czasem firmy często przyzwyczajają się do robienia tego samego i wprowadzania stopniowych ulepszeń, co ogranicza innowacyjność. W epoce AI wszystko się zmienia — musimy poczuć się trochę „niewygodnie”, by zachować kreatywność i generować przełomowe pomysły, które napędzą kolejny wielki obszar wzrostu.

Dlatego w Zhipu utworzyliśmy nowy dział X-Lab, który ma na celu w otwarty sposób przyciągać młodych ludzi do eksploracji najnowszych rozwiązań: nowych architektur modeli, paradygmatów poznawczych, a także inkubacji nowych projektów (nie tylko software, ale i hardware). Planujemy też zwiększyć inwestycje zewnętrzne — nie tylko strategicznie współpracować z obecnymi spółkami portfelowymi, ale też budować nowe obszary i łączyć cały sektor, by rozwijać ekosystem. W X-Lab każdy ma za zadanie tworzyć całkowicie przełomowe innowacje, które ostatecznie wracają do głównego nurtu AGI.

Dziś jest ekscytujący dzień w historii Zhipu, ważny kamień milowy i początek zupełnie nowej ery. Bardzo lubię markę Z.ai — Z to ostatnia litera alfabetu, symbolizująca ostateczny cel. Chcemy na drodze AGI dojść do granic inteligencji — to nasz cel. Jesteśmy bardzo podekscytowani:

- Mamy ambitny, zmieniający świat projekt

- Patrzymy daleko w przyszłość, stawiamy na długoterminowe korzyści

- Skupiamy się coraz bardziej i eksplorujemy istotę AGI

- Wspieramy wielkich przedsiębiorców i rozwój firm za pomocą AI

- Dzięki precyzyjnym przewidywaniom chwytamy szanse rozwoju

- W końcu mamy nadzieję, że wniesiemy do społeczeństwa ludzkiego nową AI, rzeczywiście wspierając postęp ludzkości.

To wyjątkowo radosny moment — radość nie z chwilowego dopaminowego zastrzyku, lecz endorfiny nagromadzone na drodze eksploracji AGI, które pozwalają nam być bardziej skupionymi, twardo stąpać po ziemi i iść naprzód!

Tang Jie

2026.1.8

Źródło grafiki tytułowej: „Diuna 2”

- FIN -

Zastrzeżenie: Treść tego artykułu odzwierciedla wyłącznie opinię autora i nie reprezentuje platformy w żadnym charakterze. Niniejszy artykuł nie ma służyć jako punkt odniesienia przy podejmowaniu decyzji inwestycyjnych.

Może Ci się również spodobać

Solana DEX Jupiter wprowadza JupUSD, zwracając natywny zysk ze skarbu użytkownikom

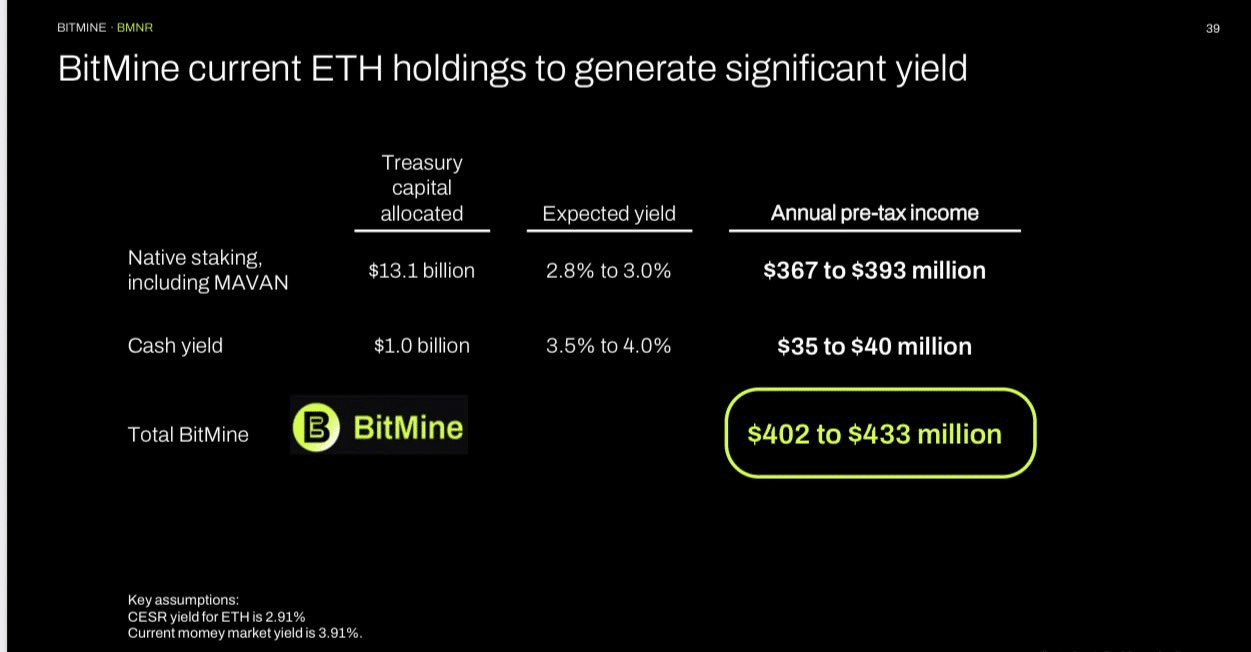

Od 3,5 tys. do 12 tys. dolarów? Oto dlaczego prognoza Ethereum BMNR ma sens